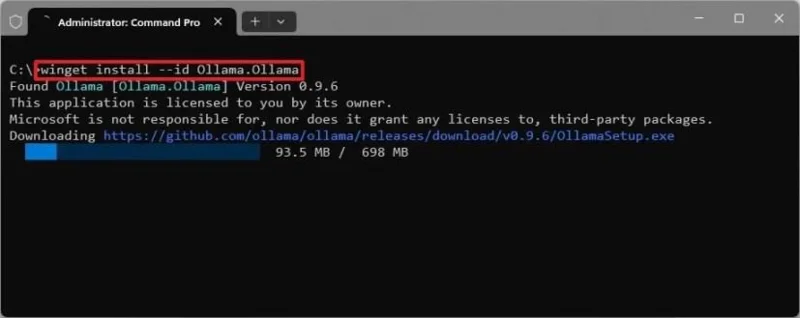

- Aby zainstalować Ollamę w systemie Windows 11, otwórz wiersz polecenia jako administrator i uruchom

winget install --id Ollama.Ollamapolecenie.

- Po zainstalowaniu użyj

ollama pull polecenia, aby pobrać i uruchomić lokalnie programy LLM, takie jak Gemma, LLaMA i DeepSeek.

- Możesz również uruchomić aplikację Ollama, aby zainstalować i uruchomić wybrane modele.

- Ollama działa niezależnie od chmury i obsługuje uruchamianie modeli za pośrednictwem interfejsu wiersza poleceń lub interfejsu niestandardowego.

AKTUALIZACJA 21.08.2025: W systemie Windows 11 możesz zainstalować Ollamę, aby pobrać i uruchomić wiele modeli sztucznej inteligencji lokalnie na swoim komputerze. W tym przewodniku przedstawię kroki, aby ukończyć tę konfigurację.

Chociaż system Windows 11 oferuje wiele wbudowanych modeli sztucznej inteligencji (AI) dla konkretnego sprzętu, takiego jak komputery Copilot+, są to zazwyczaj modele małe i wyspecjalizowane. Dlatego głównym sposobem komunikacji z modelami dużego języka (LLM) sztucznej inteligencji jest korzystanie z internetowych chatbotów, takich jak Microsoft Copilot, OpenAI ChatGPT i Google Gemini .

Wadą korzystania z tych platform LLM jest to, że przetwarzają one wszystkie żądania w chmurze, co nie jest czymś, na co każdy ma ochotę. Właśnie tutaj Ollama staje się cennym narzędziem.

Ollama to narzędzie open source , które umożliwia uruchamianie dużych modeli językowych (LJ) bezpośrednio na komputerze lokalnym z systemem Windows 11, 10 lub innym obsługiwanym systemem operacyjnym, z poziomu wiersza poleceń lub interfejsu graficznego. Zostało zaprojektowane, aby ułatwić użytkownikom, programistom i badaczom pobieranie, uruchamianie i zarządzanie tymi modelami sztucznej inteligencji.

W tym przewodniku przedstawię kroki, które należy wykonać, aby skonfigurować jedno z najłatwiejszych narzędzi do uruchamiania LLM lokalnie na komputerze.

Zainstaluj Ollamę w systemie Windows 11, aby uruchomić modele AI lokalnie

Aby zainstalować Ollamę lokalnie w systemie Windows 11, wykonaj następujące kroki:

-

Otwórz Start w systemie Windows 11.

-

Wyszukaj Wiersz polecenia (lub Terminal ), kliknij prawym przyciskiem myszy wynik powyżej i wybierz opcję Uruchom jako administrator .

-

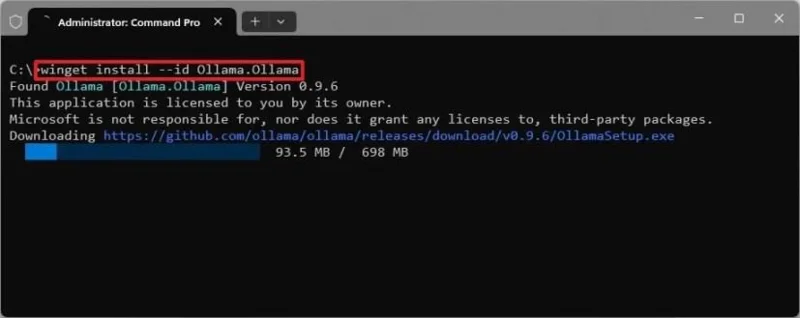

(Opcja 1) Wpisz to polecenie, aby zainstalować oficjalne narzędzie Ollama i naciśnij Enter :

instalacja wingeta --id Ollama.Ollama

-

Kliknij przycisk Zakończ .

-

(Opcja 2) Wpisz to polecenie, aby odinstalować Ollamę z systemu Windows 11 i naciśnij Enter :

dezinstalacja wingeta — identyfikator Ollama.Ollama

Szybka wskazówka: Przed usunięciem Ollama zaleca się odinstalowanie wszystkich modeli sztucznej inteligencji z komputera.

Po wykonaniu tych kroków Ollama będzie działać w tle, a wówczas będzie można korzystać z ollama wiersza poleceń, aby wchodzić z nim w interakcję z programem Command Prompt lub PowerShell.

Oprócz zainstalowania tego narzędzia za pomocą Menedżera pakietów systemu Windows (winget) , instalator Ollama można zawsze pobrać z jego oficjalnej strony lub z tej strony GitHub .

Zainstaluj i uruchom AI LLM z Ollamą w systemie Windows 11

Przed rozpoczęciem instalacji otwórz stronę biblioteki Ollama i zdecyduj, który model sztucznej inteligencji chcesz zainstalować.

Na stronie znajdziesz listę dostępnych modeli od DeepSeek , Google (gemma), Meta (llama) i innych.

Zauważysz również, że każdy model ma oznaczenia takie jak 1b, 4b, 12b itd., które wskazują liczbę parametrów w miliardach. Większa liczba parametrów oznacza większy i potencjalnie bardziej wydajny model. Wymagają one jednak również bardziej wydajnego sprzętu.

Jeśli dopiero zaczynasz, powinieneś pobrać najmniejszą dostępną wersję (na przykład „1b”).

Aby zainstalować model sztucznej inteligencji przy użyciu Ollama w systemie Windows 11, wykonaj następujące kroki:

-

Otwórz Start .

-

Wyszukaj Wiersz polecenia (lub Terminal ), kliknij prawym przyciskiem myszy wynik powyżej i wybierz opcję Uruchom jako administrator .

-

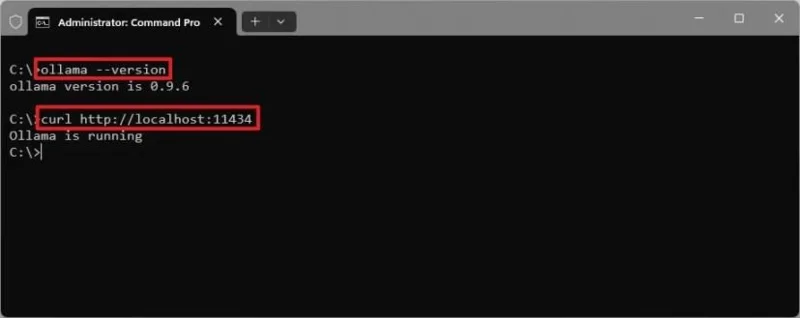

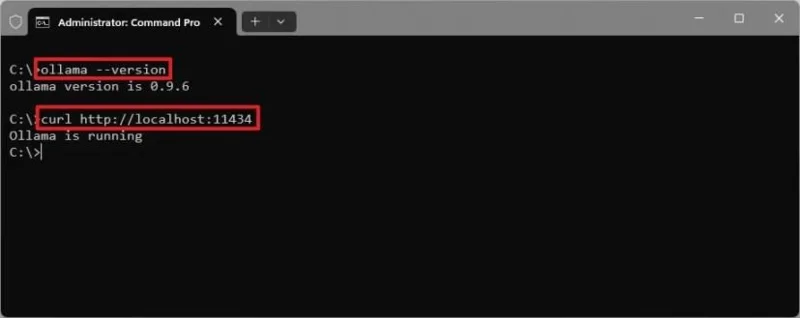

(Opcjonalnie) Wpisz to polecenie, aby sprawdzić wersję Ollama i naciśnij Enter :

ollama --wersja

-

(Opcjonalnie) Wpisz to polecenie, aby potwierdzić, że Ollama działa i naciśnij Enter :

curl http://localhost:11434

-

(Opcja 1) Wpisz to polecenie, aby zainstalować i uruchomić model AI lokalnie na swoim komputerze i naciśnij Enter :

ollama pull gemma3:1b

Krótka uwaga: To polecenie pobiera wersję 3 Google Gemma, która zawiera miliard parametrów. W poleceniu zaktualizuj gemma3:1b nazwę modelu i wersję, którą chcesz zainstalować, na przykład deepseek-r1:1.5b.

-

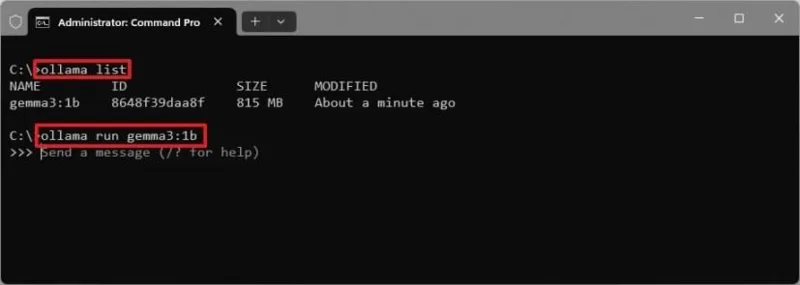

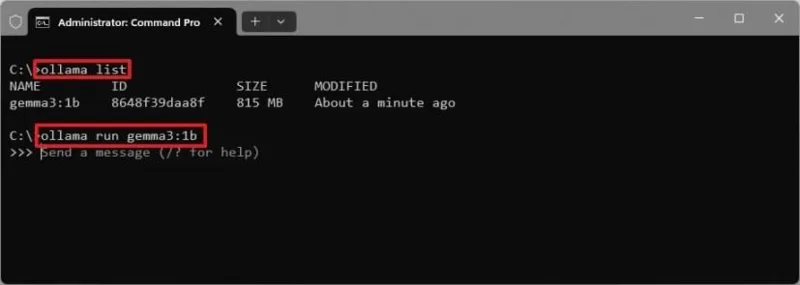

(Opcjonalnie) Wpisz to polecenie, aby wyświetlić zainstalowane modele i naciśnij Enter :

lista ollama

-

(Opcja 2) Wpisz to polecenie, aby odinstalować model AI z komputera i naciśnij Enter :

ollama rm gemma3:1b

-

Wpisz to polecenie, aby potwierdzić, że model nie znajduje się już na Twoim komputerze i naciśnij Enter :

lista ollama

-

Wpisz to polecenie, aby uruchomić model AI zainstalowany przy użyciu Ollama i naciśnij Enter :

ollama run gemma3:1b

W poleceniu potwierdź model, którego chcesz używać z Ollamą.

-

(Opcjonalnie) Wpisz to polecenie, aby wyświetlić wszystkie uruchomione procesy Ollama i naciśnij Enter :

ollama ps

-

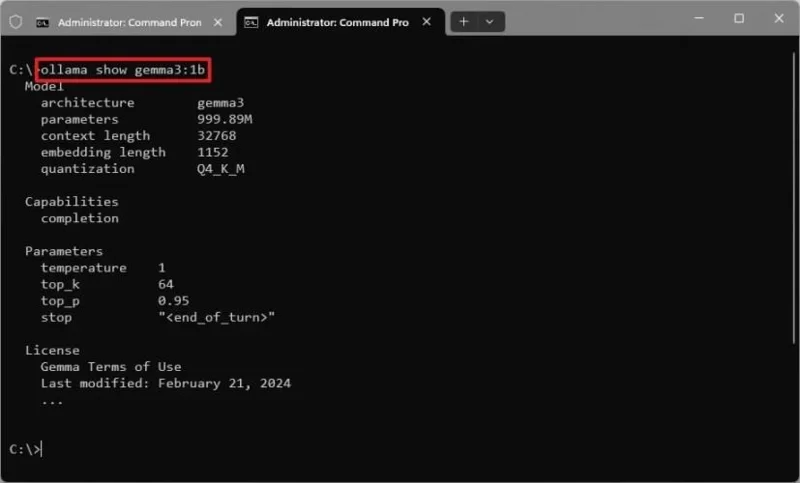

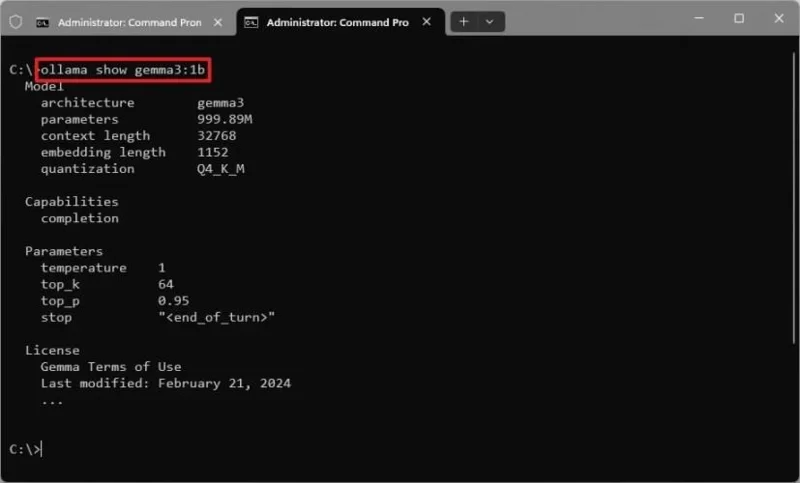

(Opcjonalnie) Wpisz to polecenie, aby wyświetlić szczegóły konkretnego modelu, takie jak konfiguracja i parametry, i naciśnij Enter :

ollama show gemma3:1b

W poleceniu potwierdź model, którego chcesz używać z Ollamą.

Po wykonaniu tych kroków możesz zacząć używać LLM za pomocą interfejsu wiersza poleceń.

Można również użyć tego ollama --helppolecenia, aby wyświetlić inne dostępne polecenia, oraz tego ollama run --helppolecenia, aby wyświetlić listę poleceń dostępnych dla konkretnego modelu.

Zainstaluj i uruchom AI LLM z Ollamą w systemie Windows 11 (metoda GUI)

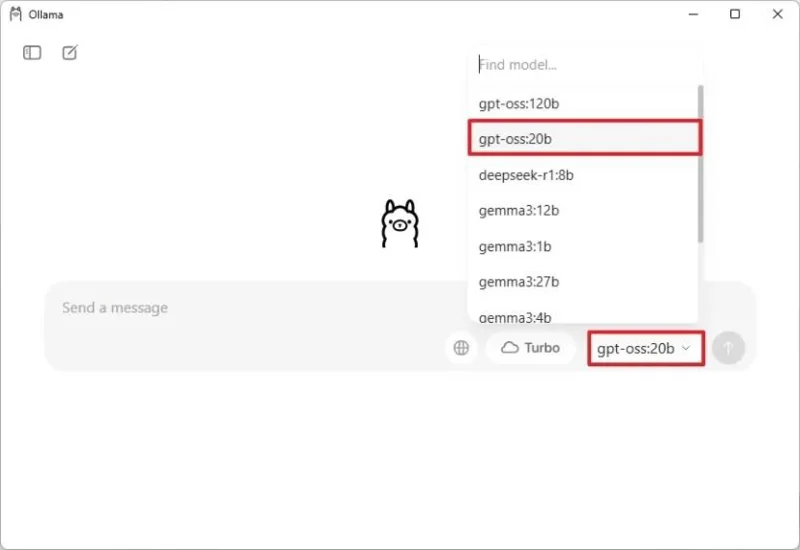

Aby zainstalować model sztucznej inteligencji przy użyciu aplikacji Ollama GUI w systemie Windows 11, wykonaj następujące kroki:

-

Jeśli aplikacja Ollama nie uruchomiła się automatycznie po instalacji, otwórz ją z menu Start.

-

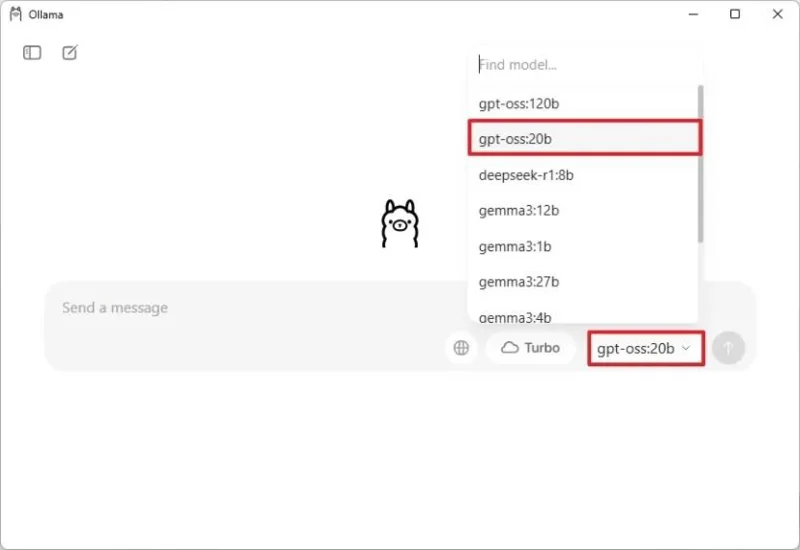

Kliknij menu modelu AI i wybierz model do pobrania. Na przykład opcję „GPT-OSS:20b” .

-

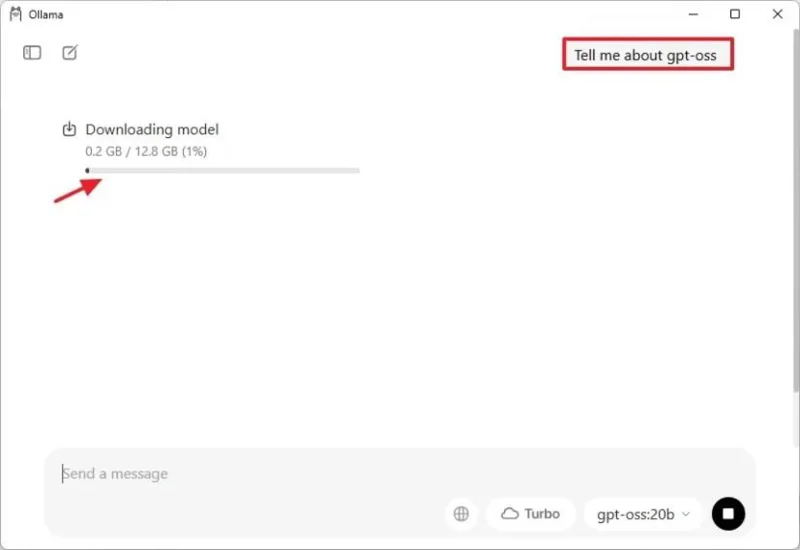

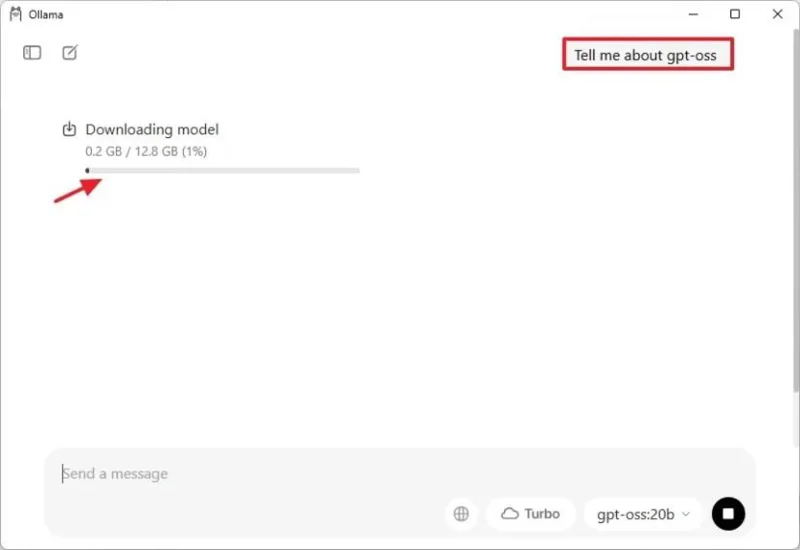

Utwórz i prześlij pytanie, aby rozpocząć pobieranie modelu GPT OpenAI.

Po wykonaniu tych kroków model sztucznej inteligencji zostanie pobrany na Twój komputer za pomocą graficznego interfejsu użytkownika.

Jeśli posiadasz konto Ollama , możesz się zalogować i korzystać z wbudowanej wyszukiwarki internetowej, która pozwoli Ci porównać możliwości danego modelu z najnowszymi informacjami dostępnymi online.

Opcja Turbo to oparta na chmurze usługa firmy Ollama, która umożliwia uruchamianie dużych modeli AI z wykorzystaniem sprzętu klasy centrum danych. Została zaprojektowana z myślą o zapewnieniu wysokiej wydajności i szybkości w przypadku modeli, które mogą być zbyt duże lub zbyt wolne do uruchomienia na komputerze lokalnym. Miesięczna subskrypcja kosztuje 20 dolarów.

Aplikacja Ollama nie oferuje opcji wstępnego pobrania dostępnych modeli sztucznej inteligencji. Można jednak wykonać to zadanie za pomocą narzędzia wiersza poleceń, jak opisano powyżej.

Najczęściej zadawane pytania dotyczące Ollama w systemie Windows 11

Jeśli nadal masz pytania dotyczące Ollama, poniższe FAQ pomogą Ci wyjaśnić różne aspekty tego narzędzia. Zawsze możesz zamieścić swoje pytania w komentarzach poniżej.

Czy do uruchomienia Ollama potrzebny jest specjalny sprzęt AI?

Nie, możesz uruchomić podstawowe modele sztucznej inteligencji (AI), które zdobyłeś za pomocą Ollama, na stosunkowo nowoczesnym sprzęcie i nie potrzebujesz do tego jednostki przetwarzania neuronowego (NPU). Ollama może również działać bezpośrednio w procesorze, ale zdecydowanie zaleca się użycie karty graficznej.

Do uruchomienia różnych modeli sztucznej inteligencji (AI) potrzebny będzie jednak określony sprzęt, w zależności od ich parametrów. Na przykład, model gpt-oss-20b można uruchomić na standardowym, nowoczesnym sprzęcie, ale jeśli chcesz użyć modelu gpt-oss-120b , potrzebny będzie bardzo wydajny sprzęt, taki jak karta graficzna NVIDIA z co najmniej 80 GB pamięci VRAM, procesor klasy serwerowej (np. AMD EPYC lub Intel Xeon), co najmniej 256 GB pamięci RAM oraz szybki dysk SSD NVMe z co najmniej 500 GB wolnego miejsca na wagi modeli i pliki tymczasowe.

Jakie są wymagania systemowe Ollama dla systemu Windows 11?

Wymagania systemowe instalacji Ollama w systemie Windows 11 lub 10 są umiarkowane:

- Procesor: Intel lub AMD x86-64.

- Pamięć: 8 GB, ale zalecane jest 16 GB lub więcej.

- Pamięć: 10 GB wolnego miejsca.

- Grafika: Zintegrowany lub dedykowany procesor graficzny.

Chociaż wymagania nie są znaczące, polecam nowoczesny procesor wielordzeniowy, co najmniej 32 GB pamięci RAM, ponad 256 GB wolnego miejsca na dysku SSD (preferowany NVMe) oraz kartę graficzną taką jak Nvidia z serii RTX 30xx. Zawsze można jednak użyć równoważnej karty graficznej AMD Radeon.

Ponadto w przypadku zaawansowanych modeli zalecane jest minimum 4 GB pamięci VRAM.

Im większy model, tym więcej zasobów będzie potrzebnych, a to oznacza, że maszyna będzie potrzebowała bardziej wytrzymałego sprzętu.

Czy Ollama wykorzystuje wirtualizację do działania w systemie Windows 11?

Nie, Ollama nie tworzy samej maszyny wirtualnej. Tworzy jednak odizolowane środowisko w systemie do uruchamiania modeli LLM. Środowisko to zawiera wszystkie niezbędne komponenty, takie jak wagi modeli (wstępnie wytrenowane dane) i pliki konfiguracyjne.

Warto zauważyć, że Ollama nie wymaga już WSL2 . Działa natywnie w najnowszej wersji systemu Windows 11 lub 10.

Aktualizacja z 21 sierpnia 2025 r.: Niniejszy przewodnik został zaktualizowany w celu zapewnienia dokładności i uwzględnienia zmian w procesie.