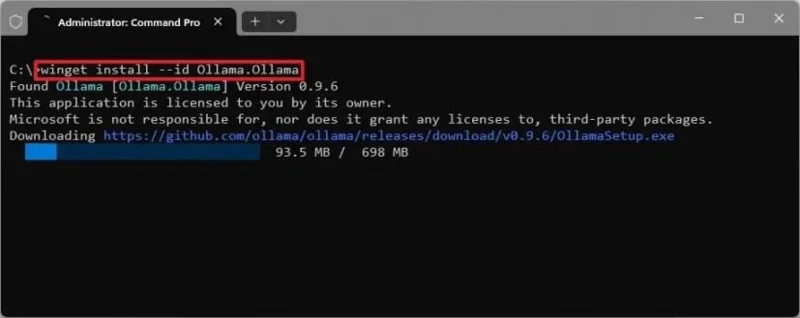

- Aby zainstalować model Google Gemma AI w systemie Windows 11, najpierw otwórz wiersz polecenia jako administrator i uruchom polecenie

winget install --id Ollama.Ollama.

- Po drugie, użyj

ollama pull gemma3:1bpolecenia, aby pobrać i zainstalować (na przykład) Gemma 3 lokalnie na swoim komputerze.

W systemie Windows 11 możesz zainstalować i uruchomić lokalnie na swoim komputerze modele Google DeepMind AI, takie jak Gemma 3 lub Gemma 3n. W tym przewodniku przedstawię kroki, które należy wykonać, aby ukończyć tę konfigurację.

Gemma 3 i 3n należą do rodziny otwartych i lekkich modeli sztucznej inteligencji Google „Gemma” . Gemma 3 została zaprojektowana z myślą o szerszym zakresie możliwości i wysokiej wydajności, natomiast Gemma 3n została zaprojektowana specjalnie z myślą o maksymalnej wydajności na urządzeniach mobilnych, brzegowych i innych urządzeniach o ograniczonych zasobach, nawet z obsługą sygnału audio.

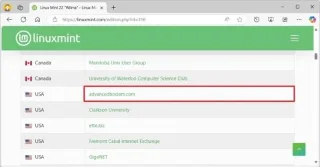

Jeśli chcesz uruchomić te modele sztucznej inteligencji lokalnie (niezależnie od chmury) na swoim komputerze, najłatwiejszą metodą jest użycie Ollama , czyli narzędzia typu open source , które umożliwia uruchamianie dużych modeli językowych bezpośrednio na komputerze lokalnym z systemem Windows 11, 10 lub inną platformą.

W tym przewodniku przedstawię kroki konfiguracji modeli Gemma AI w systemie Windows 11.

Zainstaluj model Google Gemma AI w systemie Windows 11

Aby zainstalować Gemma 3 lub 3n lokalnie w systemie Windows 11, wykonaj następujące kroki:

-

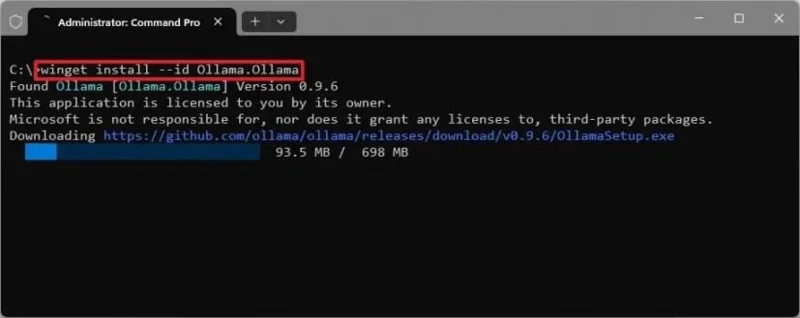

Otwórz Start w systemie Windows 11.

-

Wyszukaj Wiersz polecenia (lub Terminal ), kliknij prawym przyciskiem myszy wynik powyżej i wybierz opcję Uruchom jako administrator .

-

Wpisz to polecenie, aby zainstalować oficjalne narzędzie Ollama i naciśnij Enter :

instalacja wingeta --id Ollama.Ollama

-

Kliknij przycisk Zakończ , aby zakończyć instalację.

-

(Opcja 1) Wpisz to polecenie, aby zainstalować lokalnie model Google Gemma 3 AI i naciśnij Enter :

ollama pull gemma3:1b

Krótka uwaga: To polecenie pobiera wersję 3 Google Gemma, która zawiera miliard parametrów. W poleceniu zaktualizuj gemma3:1bnazwę modelu i wersję, którą chcesz zainstalować, na przykład gemma3:4b, gemma3:12blub gemma3:27b.

-

(Opcja 2) Wpisz to polecenie, aby zainstalować lokalnie model Google Gemma 3n AI i naciśnij Enter :

ollama pull gemma3n:e2b

Krótka uwaga: To polecenie pobiera Google Gemma 3n . W poleceniu wpisz gemma3n:e2bnazwę i wersję modelu, którą chcesz zainstalować, np gemma3n:e4b. .

-

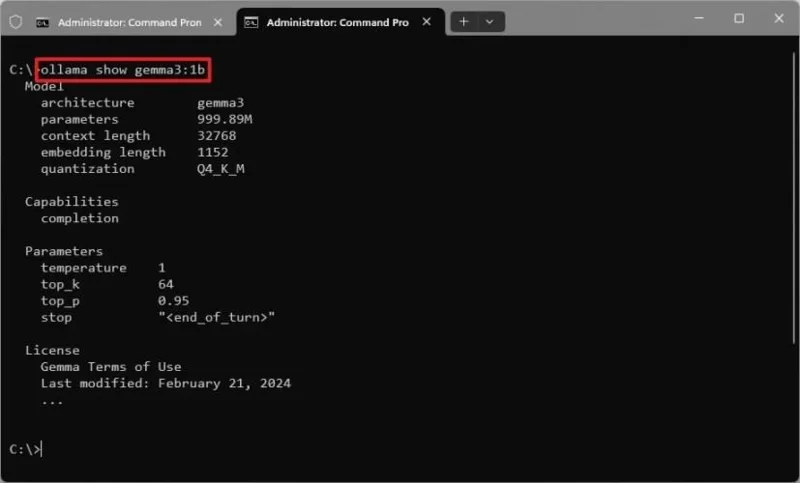

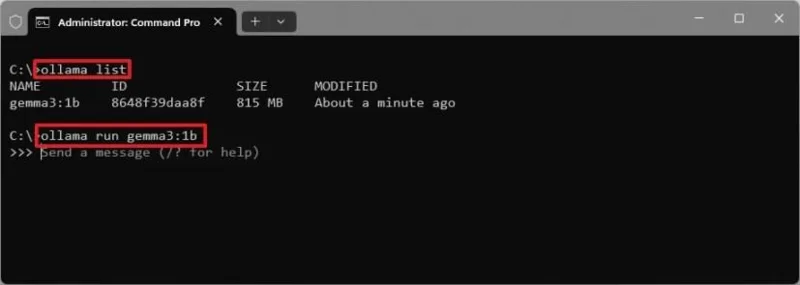

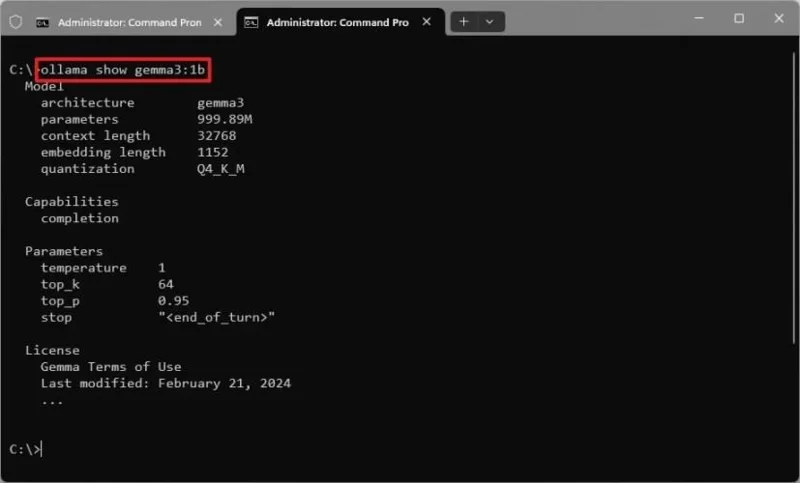

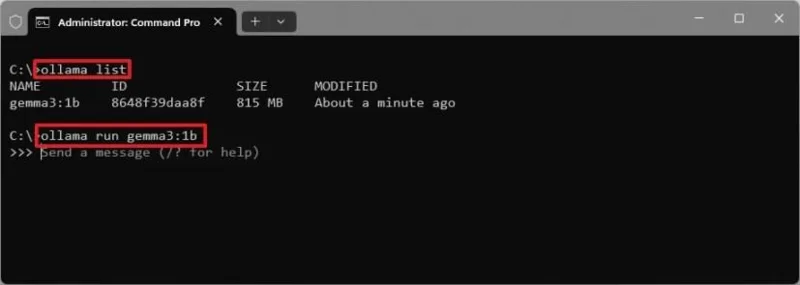

(Opcjonalnie) Wpisz to polecenie, aby potwierdzić, że model AI został zainstalowany i naciśnij Enter :

lista ollama

-

(Opcjonalnie) Wpisz to polecenie, aby wyświetlić szczegóły (na przykład) modelu Gemma 3, takie jak konfiguracja i parametry, a następnie naciśnij Enter :

ollama show gemma3:1b

-

Wpisz to polecenie, aby uruchomić (na przykład) model Gemma 3 AI i naciśnij Enter :

ollama run gemma3:1b

Po wykonaniu tych kroków możesz zacząć korzystać z modelu Google Gemma AI za pośrednictwem interfejsu wiersza poleceń.

Oprócz zainstalowania tego narzędzia za pomocą Menedżera pakietów systemu Windows (winget) , instalator Ollama można zawsze pobrać z jego oficjalnej strony lub z tej strony GitHub .

Można również użyć tego ollama --helppolecenia, aby wyświetlić inne dostępne polecenia, oraz tego ollama run --helppolecenia, aby wyświetlić listę poleceń dostępnych dla konkretnego modelu.