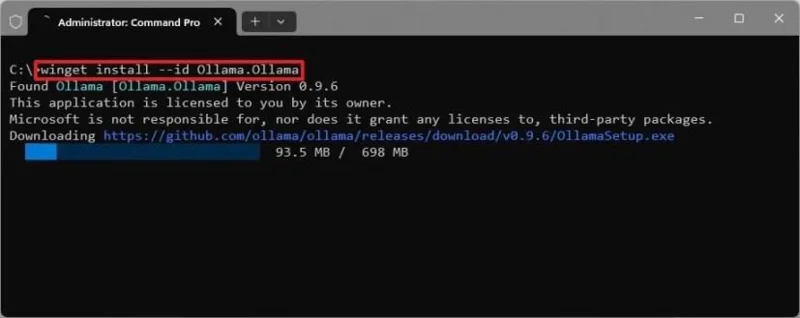

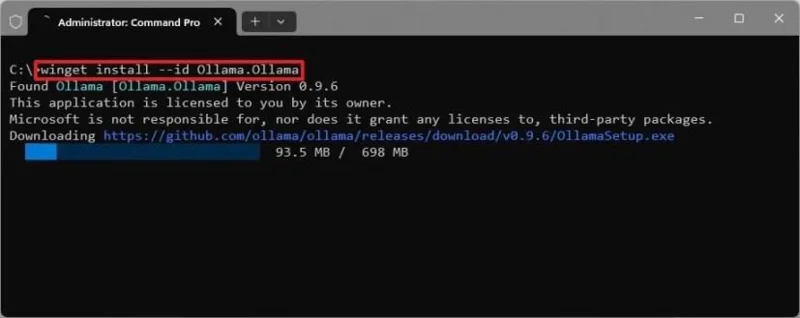

- Aby zainstalować model GPT-OSS AI w systemie Windows 11, najpierw otwórz wiersz polecenia (administrator) i uruchom polecenie

winget install --id Ollama.Ollama.

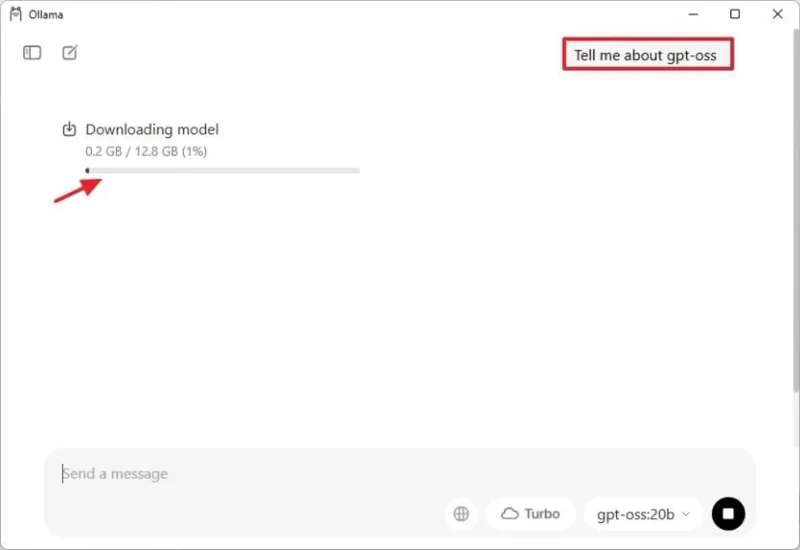

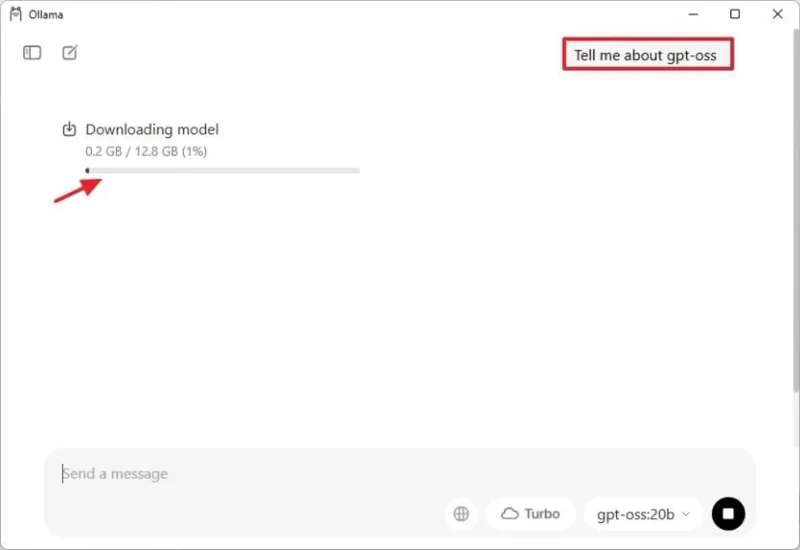

- Następnie należy wybrać opcję

gpt-oss:20bz listy i przesłać pytanie, aby rozpocząć pobieranie.

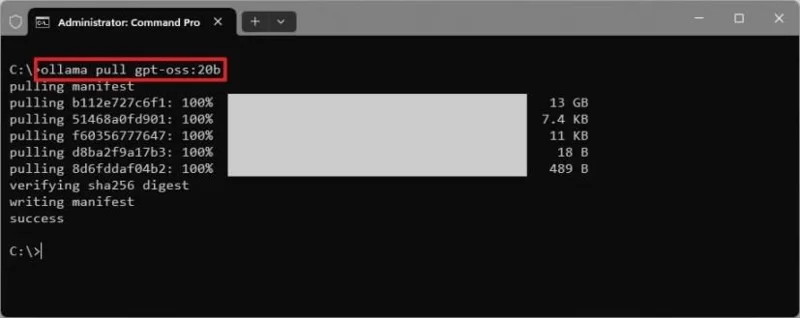

- Alternatywnie możesz użyć narzędzia wiersza poleceń Ollama w wierszu poleceń (administrator) i użyć tego

ollama pull gpt-oss:20b polecenia, aby pobrać i zainstalować (na przykład) GPT-OSS lokalnie na swoim komputerze.

W systemie Windows 11 możesz zainstalować i uruchomić lokalnie na swoim komputerze najnowszy model sztucznej inteligencji GPT-OSS (oprogramowanie Open Source) z witryny OpenAI. W tym przewodniku przedstawię kroki, które należy wykonać, aby ukończyć tę konfigurację.

GPT-OSS to model tekstowy z rodziny otwartych modeli językowych OpenAI. Obecnie mamy dwie wersje, w tym gpt-oss-20b (z około 21 mld parametrów) i gpt-oss-120b (z około 117 mld parametrów), które zostały udostępnione na licencji Apache 2.0, co pozwala każdemu na ich swobodne pobieranie, uruchamianie, modyfikowanie i redystrybucję.

- gpt-oss-20b: Na tyle kompaktowy, że można go uruchomić na standardowym sprzęcie z co najmniej 16 GB pamięci (np. laptopach, szybkich telefonach) i znakomicie radzi sobie z zadaniami lokalnymi o niskim opóźnieniu.

- gpt-oss-120b: To większy model, zaprojektowany do wymagających zadań logicznych. Działa na konfiguracjach najwyższej klasy, takich jak pojedynczy procesor graficzny 80 GB, i oferuje wydajność zbliżoną do O4-mini.

Modele te obsługują rozumowanie oparte na łańcuchu myślowym, wykorzystywanie narzędzi, długie okna kontekstowe i oferują konfigurowalne poziomy rozumowania, takie jak niski, średni i wysoki, co zapewnia elastyczność.

Co mogę zrobić z GPT-OSS jako zwykły użytkownik?

Jeśli jesteś użytkownikiem, programistą lub entuzjastą technologii, nowe modele OpenAI umożliwiają uruchomienie chatbota lokalnie na Twoim komputerze bez konieczności wykupywania subskrypcji i z pełną kontrolą nad Twoimi danymi.

Jeśli jesteś gotowy na to zadanie, możesz eksperymentować, dostosowywać i udoskonalać model, ponieważ jest on objęty licencją Apache 2.0.

Zazwyczaj GPT-OSS służy do pomocy w kodowaniu, rozwiązywania złożonych problemów, prowadzenia rozmów i obsługi przepływów pracy agentów . Dodatkowo, można z niego korzystać w trybie offline, bez połączenia z internetem.

Jaka jest grupa docelowa OpenAI GPT-OSS?

Te modele sztucznej inteligencji są przeznaczone dla programistów, badaczy, pracowników naukowych i osób zajmujących się technologią.

Jeśli chcesz uruchomić te modele sztucznej inteligencji lokalnie (niezależnie od chmury) na swoim komputerze, najłatwiejszą metodą jest użycie Ollama , czyli narzędzia typu open source , które umożliwia uruchamianie dużych modeli językowych bezpośrednio na komputerze lokalnym z systemem Windows 11, 10 lub inną platformą.

Chociaż najlepiej instalować i uruchamiać modele AI na urządzeniach z NPU (jednostką przetwarzania neuronowego) , takich jak komputer Copilot+ z procesorem Snapdragon, modele te można uruchomić praktycznie na każdym sprzęcie. Ollama współpracuje również z firmą Nvidia, aby przyspieszyć GPT-OSS na kartach graficznych GeForce RTX i RTX Pro .

Jedyne, co mogę powiedzieć, to że bez NPU lub wydajnego procesora graficznego, chatbot oparty na sztucznej inteligencji może potrzebować bardzo dużo czasu, aby odpowiedzieć na proste pytanie.

W tym przewodniku przedstawię kroki konfiguracji modeli Gemma AI w systemie Windows 11.

Instalacja GPT-OSS w systemie Windows 11 za pomocą Ollama (metoda GUI)

Aby zainstalować GPT-OSS lub 3n lokalnie w systemie Windows 11, wykonaj następujące kroki:

-

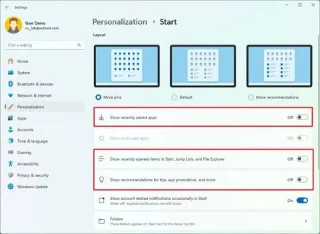

Otwórz Start w systemie Windows 11.

-

Wyszukaj Wiersz polecenia (lub Terminal ), kliknij prawym przyciskiem myszy wynik powyżej i wybierz opcję Uruchom jako administrator .

-

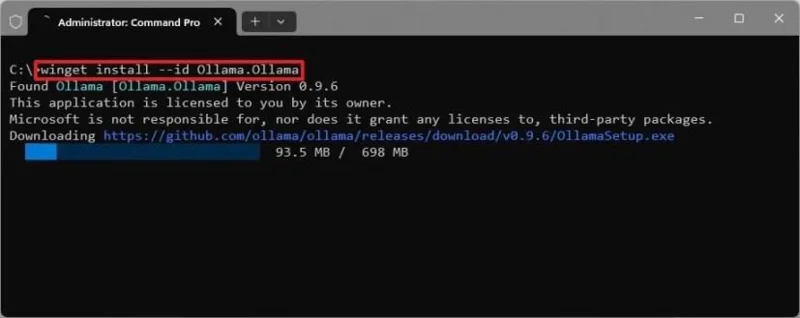

Wpisz to polecenie, aby zainstalować oficjalne narzędzie Ollama i naciśnij Enter :

instalacja wingeta --id Ollama.Ollama

-

Kliknij przycisk Zakończ , aby zakończyć instalację.

-

Jeśli aplikacja Ollama nie uruchomiła się automatycznie, otwórz ją z menu Start.

-

Kliknij menu modelu AI i wybierz opcję „GPT-OSS:20b” .

-

Utwórz i prześlij pytanie, aby rozpocząć pobieranie modelu GPT OpenAI.

Po wykonaniu tych kroków możesz zacząć korzystać z modelu AI GPT-OSS za pośrednictwem interfejsu wiersza poleceń.

Jeśli posiadasz konto Ollama , możesz się zalogować i korzystać z wbudowanej wyszukiwarki internetowej, która pozwoli Ci porównać możliwości danego modelu z najnowszymi informacjami dostępnymi online.

Jeśli się zastanawiasz, opcja Turbo to oparta na chmurze usługa firmy Ollama, która umożliwia uruchamianie dużych modeli AI z wykorzystaniem sprzętu klasy centrum danych. Została zaprojektowana z myślą o zapewnieniu wysokiej wydajności i szybkości w przypadku modeli, które mogą być zbyt duże lub zbyt wolne do uruchomienia na komputerze lokalnym. Miesięczna subskrypcja kosztuje 20 dolarów.

Aplikacja Ollama nie oferuje opcji wstępnego pobrania dostępnych modeli sztucznej inteligencji. Można jednak wykonać to zadanie za pomocą narzędzia wiersza poleceń.

Instalacja GPT-OSS w systemie Windows 11 za pomocą Ollama (metoda CLI)

Aby zainstalować OpenAI GPT-OSS lokalnie w systemie Windows 11, wykonaj następujące kroki:

-

Otwórz Start .

-

Wyszukaj Wiersz polecenia (lub Terminal ), kliknij prawym przyciskiem myszy wynik powyżej i wybierz opcję Uruchom jako administrator .

-

Wpisz to polecenie, aby zainstalować oficjalne narzędzie Ollama i naciśnij Enter :

instalacja wingeta --id Ollama.Ollama

-

Kliknij przycisk Zakończ , aby zakończyć instalację.

-

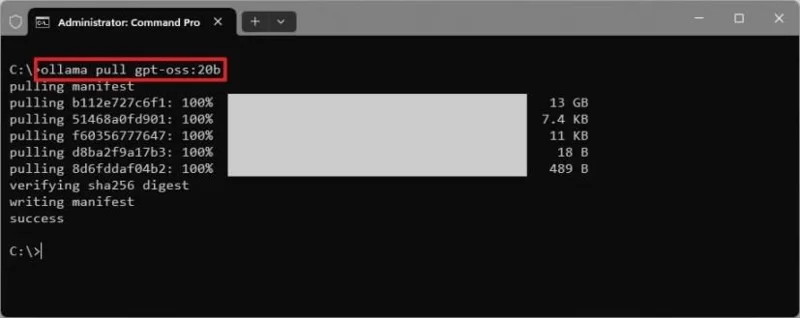

(Opcja 1) Wpisz to polecenie, aby zainstalować lokalnie mniejszy model AI GPT-OSS i naciśnij Enter :

ollama pull gpt-oss:20b

Krótka uwaga: To polecenie pobiera plik gpt-oss:20b, który zawiera 20 miliardów parametrów. Możesz jednak skorzystać z gpt-oss:latestopcji pobrania najnowszego modelu dostępnego w danym momencie.

-

(Opcja 2) Wpisz to polecenie, aby zainstalować lokalnie większy model GPT-OSS AI i naciśnij Enter :

ollama pull gpt-oss:120b

-

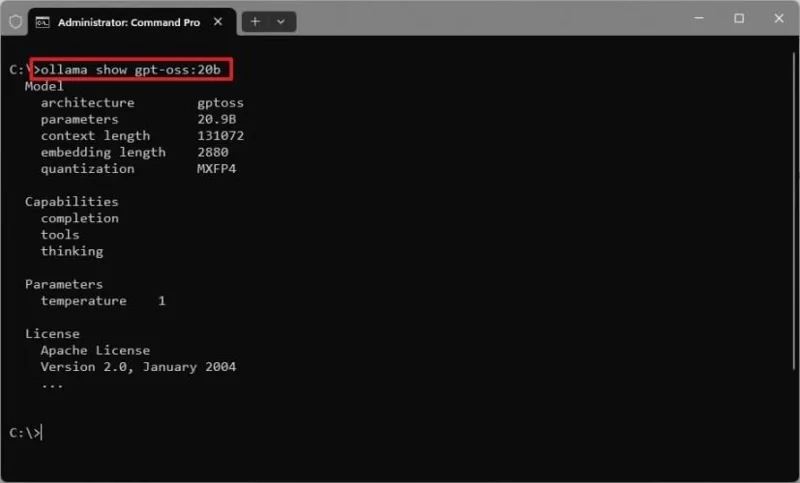

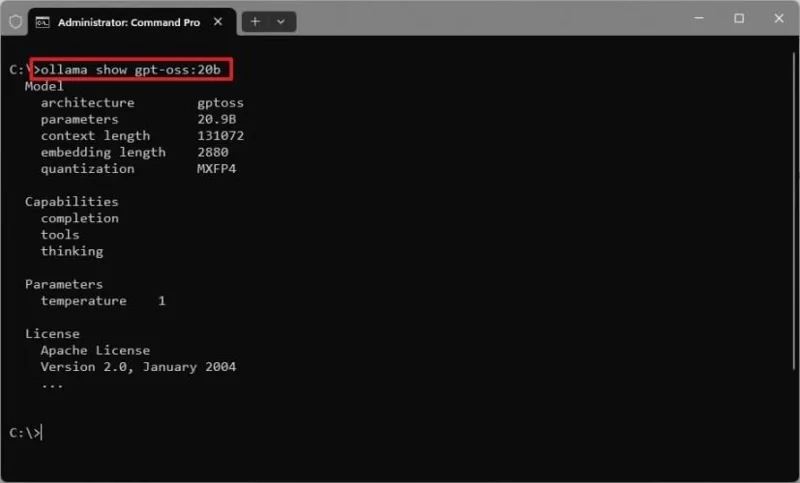

(Opcjonalnie) Wpisz to polecenie, aby potwierdzić, że model AI został zainstalowany i naciśnij Enter :

lista ollama

-

(Opcjonalnie) Wpisz to polecenie, aby wyświetlić szczegóły (na przykład) mniejszego modelu GPT-OSS, takie jak konfiguracja i parametry, a następnie naciśnij klawisz Enter :

ollama show gpt-oss:20b

-

Wpisz to polecenie, aby uruchomić (na przykład) model GTP-OSS i naciśnij Enter :

ollama run gpt-oss:20b

Po wykonaniu tych kroków możesz zacząć korzystać z najnowszego modelu GPT AI o otwartym kodzie źródłowym od OpenAI za pośrednictwem interfejsu wiersza poleceń.

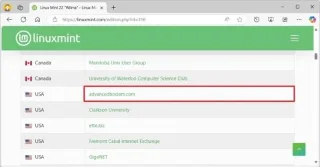

Oprócz zainstalowania tego narzędzia za pomocą Menedżera pakietów systemu Windows (winget) , instalator Ollama można zawsze pobrać z jego oficjalnej strony lub z tej strony GitHub .

Można również użyć tego ollama --helppolecenia, aby wyświetlić inne dostępne polecenia, oraz tego ollama run --helppolecenia, aby wyświetlić listę poleceń dostępnych dla konkretnego modelu.

Jeśli planujesz uruchomić na swoim komputerze jeden z tych modeli sztucznej inteligencji, powinieneś wybrać model gpt-oss-20b ze względu na jego wymagania sprzętowe i zajmowane miejsce.

Jeśli chcesz użyć modelu gpt-oss-120b , będziesz potrzebować bardzo wydajnego sprzętu, takiego jak procesor graficzny NVIDIA z co najmniej 80 GB pamięci VRAM, procesor klasy serwerowej (na przykład AMD EPYC lub Intel Xeon), co najmniej 256 GB pamięci i szybki dysk SSD NVMe z co najmniej 500 GB wolnego miejsca na wagi modeli i pliki tymczasowe.