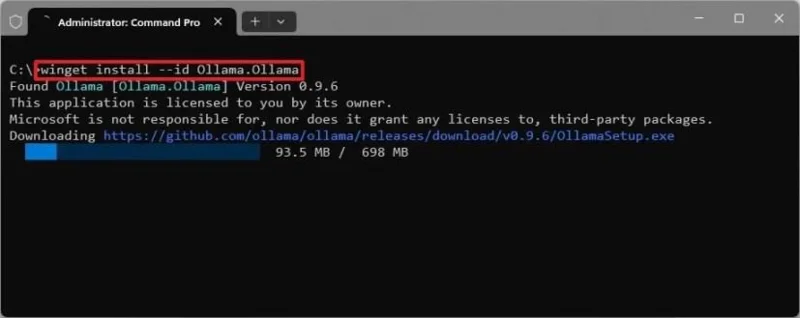

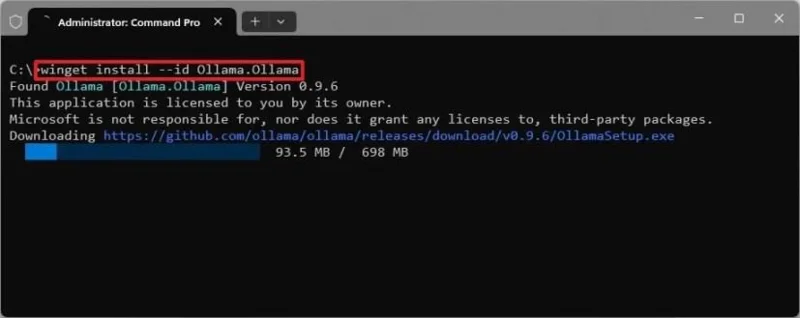

- Pentru a instala Ollama pe Windows 11, deschideți Linia de comandă ca administrator și executați

winget install --id Ollama.Ollamacomanda.

- După instalare, utilizați

ollama pull comanda pentru a descărca și rula local LLM-uri precum Gemma, LLaMA și DeepSeek.

- Alternativ, puteți lansa aplicația Ollama pentru a instala și rula modelele dorite.

- Ollama funcționează independent de cloud și acceptă rularea modelelor printr-o interfață de linie de comandă sau o interfață personalizată.

ACTUALIZAT 21.08.2025: Pe Windows 11 , puteți instala Ollama pentru a descărca și rula mai multe modele de inteligență artificială local pe computer, iar în acest ghid, voi prezenta pașii pentru finalizarea acestei configurații.

Deși Windows 11 vine cu multe modele de inteligență artificială încorporate pentru hardware specific, cum ar fi PC-urile Copilot+, acestea sunt de obicei modele mici și specializate. Prin urmare, principala modalitate de a interacționa cu modelele de limbaj mare (LLM) bazate pe inteligență artificială este prin intermediul chatbot-urilor online, cum ar fi Microsoft Copilot, OpenAI ChatGPT și Google Gemini , printre altele.

Avertismentul utilizării acestor LLM-uri este că acestea procesează toate cererile în cloud, lucru pe care nu îl dorește toată lumea. Aici Ollama devine un instrument valoros.

Ollama este un instrument open-source care vă permite să rulați Modele Limbajoase Mari direct pe computerul local care rulează Windows 11, 10 sau alte sisteme de operare compatibile, utilizând o experiență de linie de comandă sau o interfață grafică. Este conceput pentru a simplifica procesul de descărcare, rulare și gestionare a acestor modele de inteligență artificială pentru utilizatori individuali, dezvoltatori și cercetători.

În acest ghid , voi prezenta pașii pentru a configura unul dintre cele mai simple instrumente pentru a rula LLM-uri local pe computer.

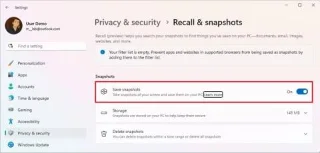

Instalați Ollama pe Windows 11 pentru a rula local modele de inteligență artificială

Pentru a instala Ollama local pe Windows 11, urmați acești pași:

-

Deschideți Start pe Windows 11.

-

Căutați Linie de comandă (sau Terminal ), faceți clic dreapta pe rezultatul de sus și alegeți opțiunea Executare ca administrator .

-

(Opțiunea 1) Tastați această comandă pentru a instala instrumentul oficial Ollama și apăsați Enter :

winget install --id Ollama.Ollama

-

Faceți clic pe butonul Finalizare .

-

(Opțiunea 2) Tastați această comandă pentru a dezinstala Ollama din Windows 11 și apăsați Enter :

dezinstalare winget--id Ollama.Ollama

Sfat rapid: Se recomandă dezinstalarea oricărui model de inteligență artificială de pe computer înainte de a elimina Ollama.

După ce finalizați pașii, Ollama va rula în fundal, apoi puteți utiliza ollama linia de comandă pentru a interacționa cu acesta din Promptul de comandă sau PowerShell.

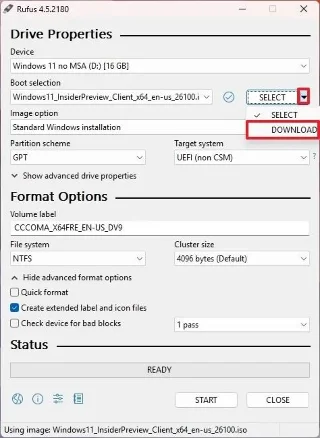

Pe lângă utilizarea Managerului de pachete Windows (winget) pentru a instala acest instrument, puteți oricând obține programul de instalare Ollama de pe pagina sa oficială sau de pe această pagină GitHub .

Instalați și rulați cursuri de AI LLM cu Ollama pe Windows 11

Înainte de a începe instalarea, deschideți pagina bibliotecii Ollama pentru a decide ce model de inteligență artificială doriți să instalați.

Pe pagină, veți găsi o listă cu modelele disponibile de la DeepSeek , Google (gemma), Meta (llama) și altele.

Veți observa, de asemenea, că fiecare model are notații precum 1b, 4b, 12b etc., care indică numărul de parametri în miliarde. Un număr mai mare de parametri indică un model mai mare și potențial mai capabil. Cu toate acestea, acestea vor necesita și hardware mai performant.

Dacă abia începi, ar trebui să descarci cea mai mică versiune disponibilă (de exemplu, „1b”).

Pentru a instala un model de inteligență artificială folosind Ollama pe Windows 11, urmați acești pași:

-

Deschideți Start .

-

Căutați Linie de comandă (sau Terminal ), faceți clic dreapta pe rezultatul de sus și alegeți opțiunea Executare ca administrator .

-

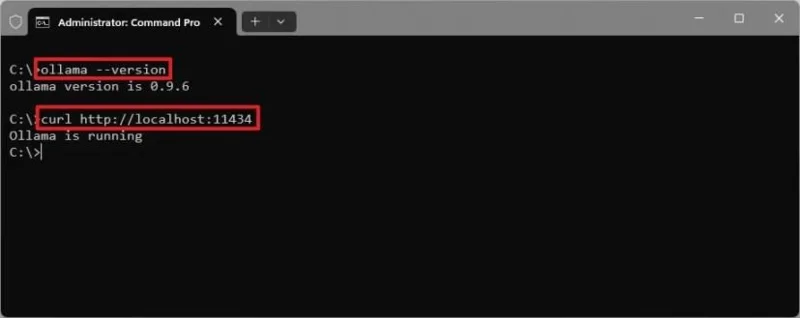

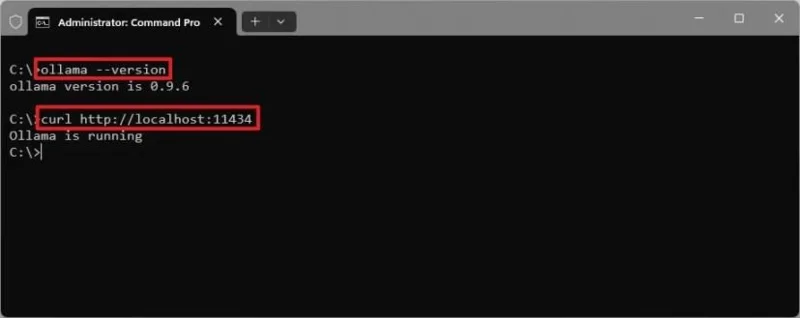

(Opțional) Tastați această comandă pentru a verifica versiunea Ollama și apăsați Enter :

ollama --versiune

-

(Opțional) Tastați această comandă pentru a confirma că Ollama rulează și apăsați Enter :

curl http://localhost:11434

-

(Opțiunea 1) Tastați această comandă pentru a instala și rula modelul AI local pe computer și apăsați Enter :

Ollama trage gemma3:1b

Notă rapidă: Această comandă descarcă Google Gemma versiunea 3, care include un miliard de parametri. În comandă, actualizați gemma3:1b pentru numele modelului și versiunea pe care doriți să o instalați, cum ar fi deepseek-r1:1.5b.

-

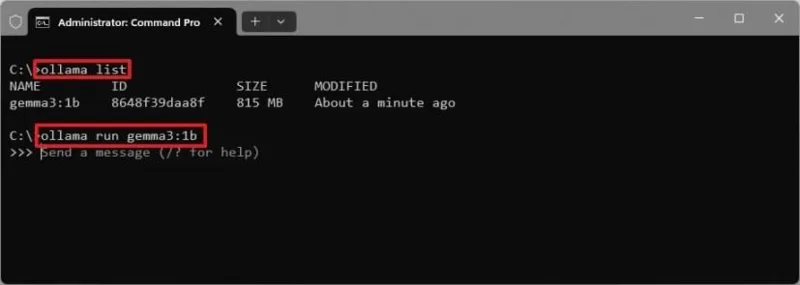

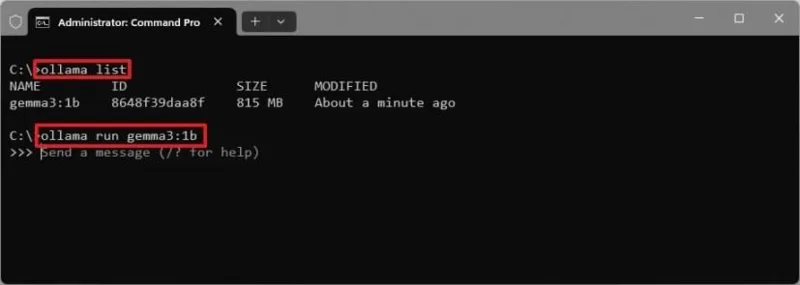

(Opțional) Tastați această comandă pentru a vizualiza modelele instalate și apăsați Enter :

lista Ollamei

-

(Opțiunea 2) Tastați această comandă pentru a dezinstala un model AI de pe computer și apăsați Enter :

Ollama RM Gemma 3:1b

-

Tastați această comandă pentru a confirma că modelul nu mai este pe computer și apăsați Enter :

lista Ollamei

-

Tastați această comandă pentru a rula un model AI instalat folosind Ollama și apăsați Enter :

Ollama Run, Gemma 3:1b

În comandă, confirmați modelul pe care doriți să începeți să îl utilizați cu Ollama.

-

(Opțional) Tastați această comandă pentru a afișa toate procesele care rulează ale Ollamei și apăsați Enter :

ollamă ps

-

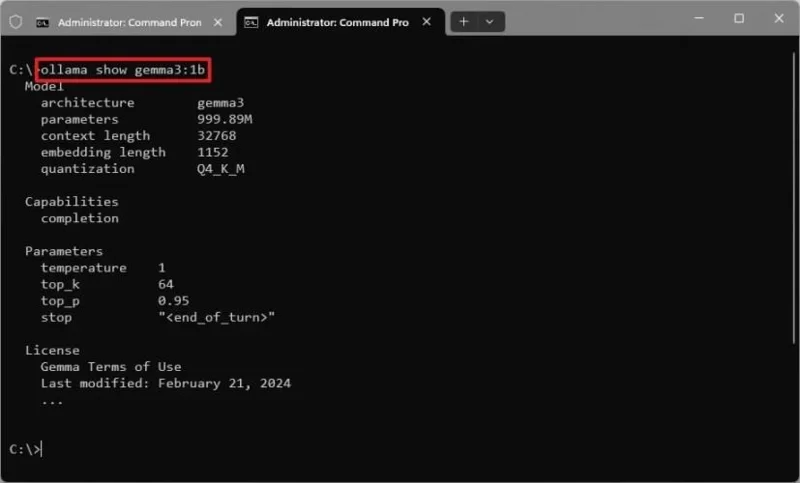

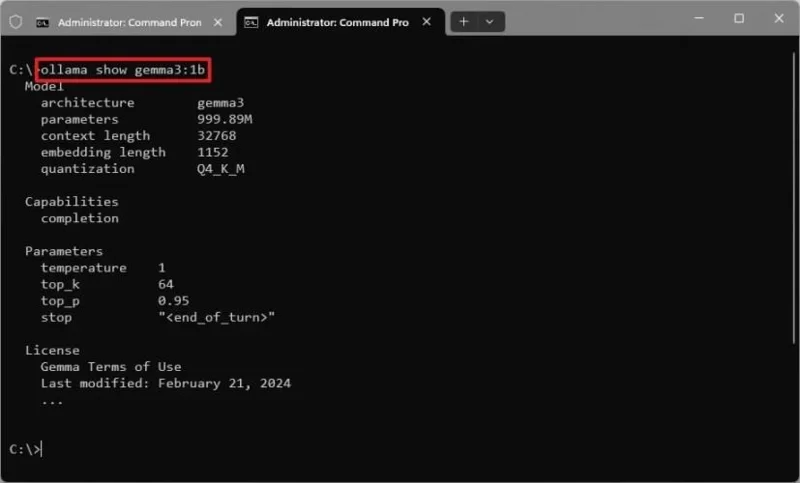

(Opțional) Tastați această comandă pentru a afișa detalii despre un anumit model, cum ar fi configurația și parametrii, apoi apăsați Enter :

spectacolul Ollama, Gemma3:1b

În comandă, confirmați modelul pe care doriți să începeți să îl utilizați cu Ollama.

După ce finalizați pașii, puteți începe să utilizați LLM prin interfața liniei de comandă.

De asemenea, puteți utiliza ollama --helpcomanda pentru a vizualiza alte comenzi disponibile și ollama run --helpcomanda pentru a lista comenzile disponibile pentru un anumit model.

Instalați și rulați AI LLM cu Ollama pe Windows 11 (metoda GUI)

Pentru a instala un model de inteligență artificială folosind aplicația GUI Ollama pe Windows 11, urmați acești pași:

-

Deschideți aplicația Ollama din meniul Start dacă nu s-a lansat automat după instalare.

-

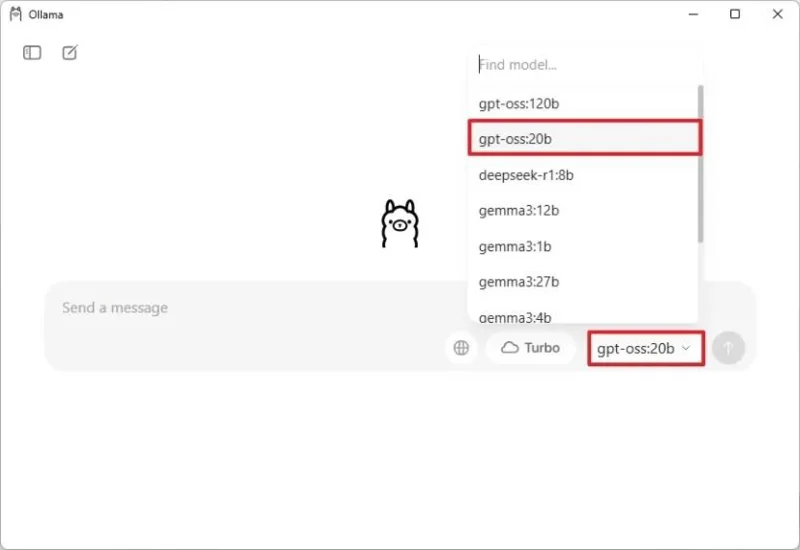

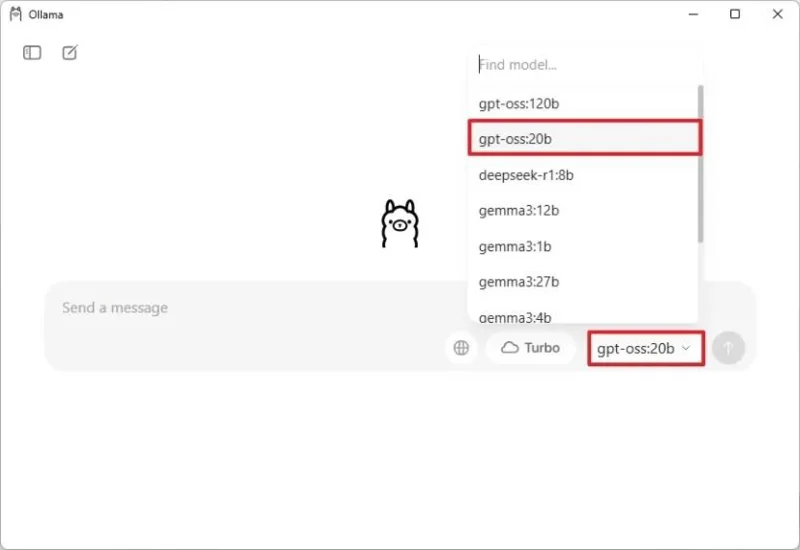

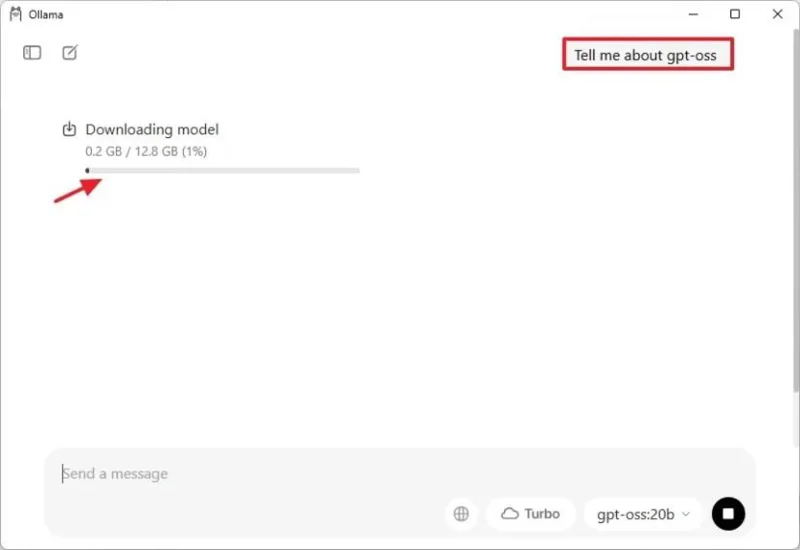

Faceți clic pe meniul modelului AI și selectați modelul de descărcat. De exemplu, opțiunea „GPT-OSS:20b” .

-

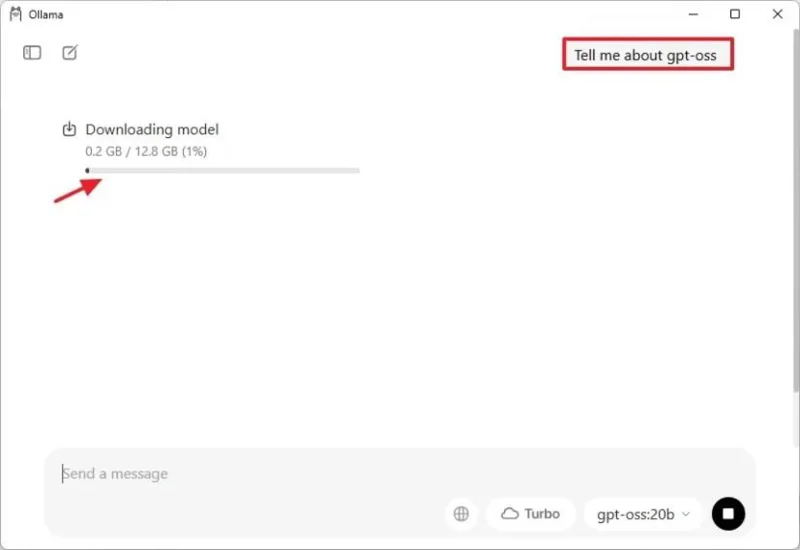

Scrieți și trimiteți o întrebare pentru a începe descărcarea modelului OpenAI GPT.

După ce finalizați pașii, modelul de inteligență artificială se va descărca pe computer prin intermediul interfeței grafice.

Dacă aveți un cont Ollama , vă puteți conecta pentru a utiliza căutarea web încorporată și a combina capacitățile modelului cu cele mai recente informații disponibile online.

Opțiunea Turbo este un serviciu bazat pe cloud de la Ollama pentru a rula modele mari de inteligență artificială folosind hardware de nivel de centru de date. Este conceput pentru a oferi performanță și viteză ridicate pentru modele care ar putea fi prea mari sau prea lente pentru a rula pe un computer local. Abonamentul lunar costă 20 USD.

Aplicația Ollama nu oferă o opțiune de predescărcare a modelelor de inteligență artificială disponibile. Cu toate acestea, puteți finaliza această sarcină din instrumentul din linia de comandă, așa cum este descris mai sus.

Întrebări frecvente despre Ollama pe Windows 11

Dacă mai aveți întrebări despre Ollama, următoarele întrebări frecvente vă vor ajuta să clarificați diferite aspecte ale acestui instrument. Puteți oricând să postați întrebările dvs. în comentariile de mai jos.

Ai nevoie de hardware specific de inteligență artificială pentru a rula Ollama?

Nu, poți rula modelele de inteligență artificială de bază pe care le-ai achiziționat folosind Ollama folosind hardware relativ modern și nu ai nevoie neapărat de o unitate de procesare neuronală (NPU). Ollama poate rula și direct în procesor, dar o placă grafică este foarte recomandată.

Totuși, veți avea nevoie de hardware specific pentru a rula diferitele modele de inteligență artificială, în funcție de parametrii acestora. De exemplu, puteți rula modelul gpt-oss-20b cu hardware modern cu capabilități normale, dar dacă doriți să utilizați modelul gpt-oss-120b , veți avea nevoie de hardware foarte performant, cum ar fi un GPU NVIDIA cu cel puțin 80 GB de VRAM, un procesor de nivel server (de exemplu, AMD EPYC sau Intel Xeon), cel puțin 256 GB de memorie și un SSD NVMe de mare viteză cu cel puțin 500 GB liberi pentru ponderile modelului și fișierele temporare.

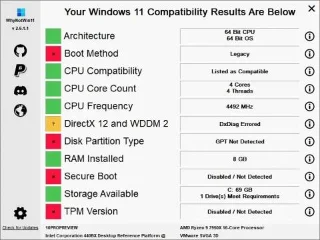

Care sunt cerințele de sistem pentru Ollama pentru Windows 11?

Cerințele de sistem pentru instalarea Ollama pe Windows 11 sau 10 sunt moderate:

- Procesor: Intel sau AMD x86-64.

- Memorie: 8 GB, dar se recomandă 16 GB și mai mult.

- Stocare: 10 GB spațiu liber.

- Grafică: GPU integrată sau dedicată.

Deși cerințele nu sunt semnificative, recomand un procesor multi-core modern, cel puțin 32 GB de RAM, peste 256 GB de spațiu liber pe un SSD (de preferință NVMe) și o placă grafică precum seria RTX 30xx de la Nvidia. Cu toate acestea, puteți utiliza oricând o placă grafică AMD Radeon echivalentă.

De asemenea, pentru modelele avansate, se recomandă un minim de 4 GB de memorie VRAM.

Cu cât modelul este mai mare, cu atât vor fi necesare mai multe resurse, ceea ce înseamnă că mașina va avea nevoie de hardware mai robust.

Folosește Ollama virtualizare pentru a rula pe Windows 11?

Nu, Ollama nu creează o mașină virtuală în sine. Cu toate acestea, creează un mediu izolat pe sistem pentru a rula LLM-uri. Acest mediu include toate componentele necesare, cum ar fi ponderile modelului (datele pre-antrenate) și fișierele de configurare.

Este important de menționat că Ollama nu mai necesită WSL2 . Rulează nativ pe cea mai recentă versiune de Windows 11 sau 10.

Actualizare 21 august 2025: Acest ghid a fost actualizat pentru a asigura acuratețea și a reflecta modificările aduse procesului.