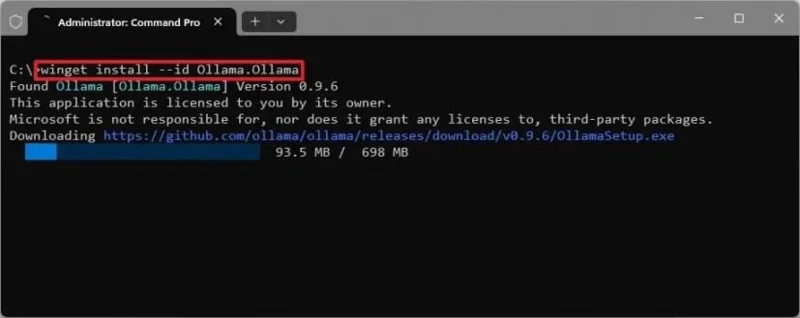

- Um das Google Gemma KI-Modell unter Windows 11 zu installieren, öffnen Sie zunächst die Eingabeaufforderung als Administrator und führen Sie den

winget install --id Ollama.OllamaBefehl aus.

- Zweitens verwenden Sie den

ollama pull gemma3:1bBefehl, um beispielsweise Gemma 3 lokal auf Ihrem Computer herunterzuladen und zu installieren.

Unter Windows 11 können Sie Google DeepMind KI-Modelle wie Gemma 3 oder Gemma 3n lokal auf Ihrem Computer installieren und ausführen. In diesem Leitfaden beschreibe ich die Schritte zur Durchführung dieser Konfiguration.

Gemma 3 und 3n gehören zu Googles „Gemma“ -Familie offener und ressourcenschonender KI-Modelle. Während Gemma 3 für ein breiteres Anwendungsspektrum konzipiert und hocheffizient ist, wurde Gemma 3n speziell für maximale Effizienz auf Mobilgeräten, Edge-Geräten und anderen ressourcenbeschränkten Geräten entwickelt und integriert sogar die Audioeingabe.

Wenn Sie diese KI-Modelle lokal (unabhängig von der Cloud) auf Ihrem Computer ausführen möchten, ist die einfachste Methode die Verwendung von Ollama. Ollama ist ein Open-Source-Tool , mit dem Sie große Sprachmodelle direkt auf Ihrem lokalen Computer unter Windows 11, 10 oder einer anderen Plattform ausführen können.

In diesem Leitfaden beschreibe ich die Schritte zur Einrichtung der Gemma AI-Modelle unter Windows 11.

Installieren Sie das Google Gemma KI-Modell unter Windows 11

Um Gemma 3 oder 3n lokal unter Windows 11 zu installieren, befolgen Sie diese Schritte:

-

Öffnen Sie das Startmenü unter Windows 11.

-

Suchen Sie nach „Eingabeaufforderung“ (oder „Terminal“ ), klicken Sie mit der rechten Maustaste auf das oberste Ergebnis und wählen Sie die Option „Als Administrator ausführen“ .

-

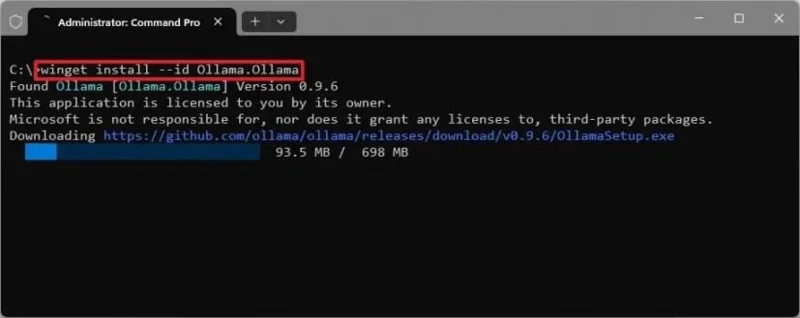

Geben Sie diesen Befehl ein, um das offizielle Ollama-Tool zu installieren, und drücken Sie die Eingabetaste :

Winget-Installation --id Ollama.Ollama

-

Klicken Sie auf die Schaltfläche „Fertigstellen “, um die Installation abzuschließen.

-

(Option 1) Geben Sie diesen Befehl ein, um das Google Gemma 3 KI-Modell lokal zu installieren, und drücken Sie die Eingabetaste :

ollama pull gemma3:1b

Kurzer Hinweis: Dieser Befehl lädt die Google Gemma Version 3 herunter, die eine Milliarde Parameter enthält. Ersetzen Sie in Ihrem Befehl gemma3:1bden Modellnamen und die Version durch den gewünschten Modellnamen und die gewünschte Version, z. B. gemma3:4b, gemma3:12b, oder gemma3:27b.

-

(Option 2) Geben Sie diesen Befehl ein, um das Google Gemma 3n KI-Modell lokal zu installieren, und drücken Sie die Eingabetaste :

ollama pull gemma3n:e2b

Kurzer Hinweis: Dieser Befehl lädt Google Gemma 3n herunter . Ersetzen Sie in Ihrem Befehl gemma3n:e2bden Modellnamen und die Version durch den Namen, den/die Sie installieren möchten, z. B. gemma3n:e4b.

-

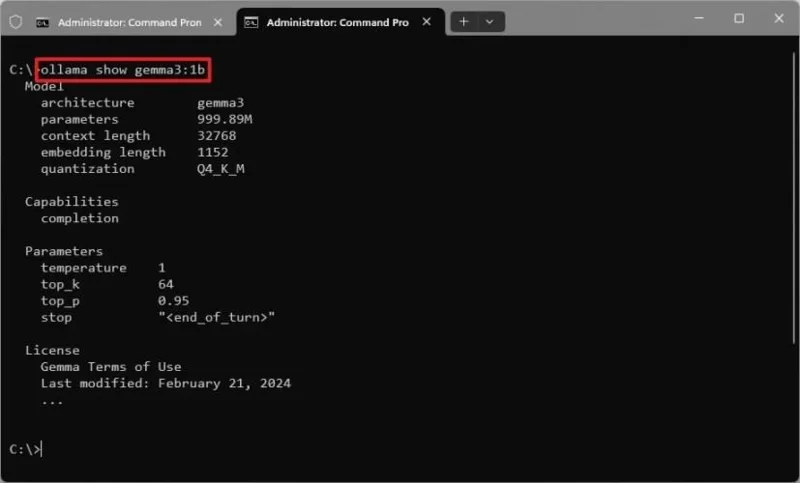

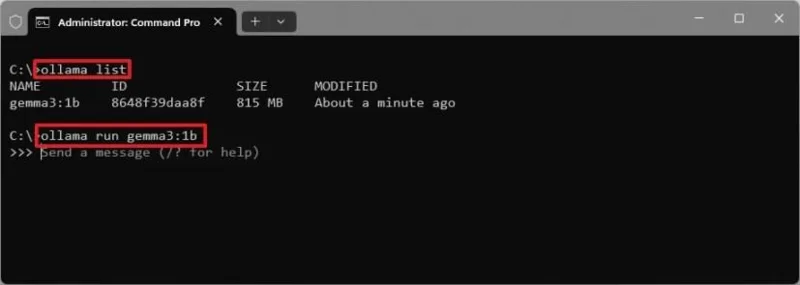

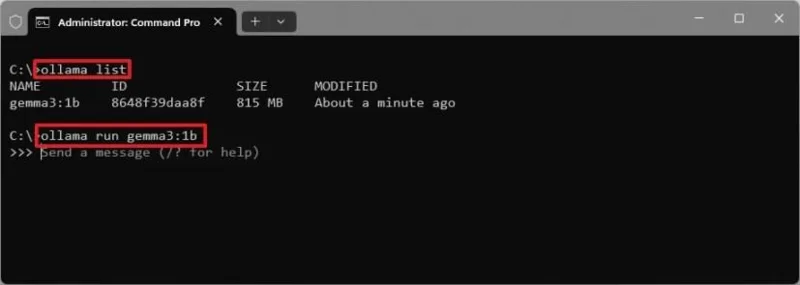

(Optional) Geben Sie diesen Befehl ein, um zu bestätigen, dass das KI-Modell installiert wurde, und drücken Sie die Eingabetaste :

Ollama-Liste

-

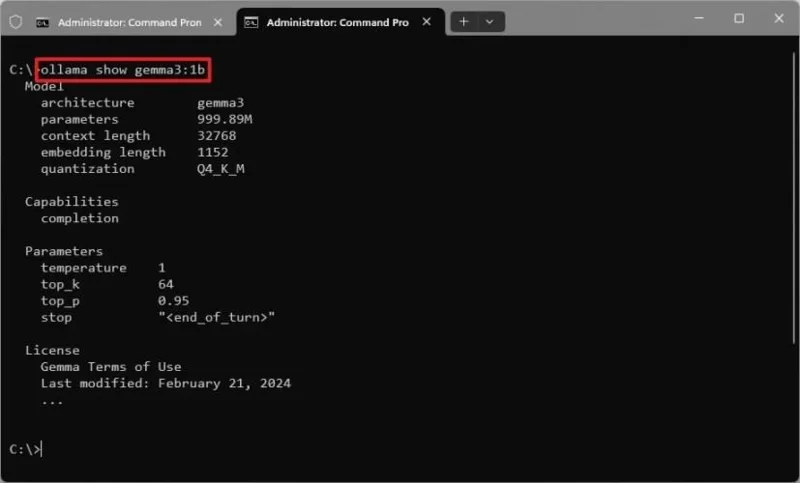

(Optional) Geben Sie diesen Befehl ein, um Details (zum Beispiel) des Modells Gemma 3, wie Konfiguration und Parameter, anzuzeigen, und drücken Sie die Eingabetaste :

ollama show gemma3:1b

-

Geben Sie diesen Befehl ein, um beispielsweise das Gemma 3 KI-Modell auszuführen, und drücken Sie die Eingabetaste :

ollama run gemma3:1b

Sobald Sie die Schritte abgeschlossen haben, können Sie das Google Gemma KI-Modell über die Befehlszeilenschnittstelle verwenden.

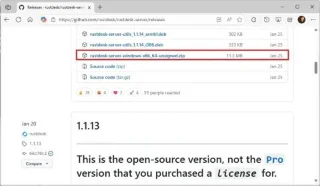

Neben der Verwendung des Windows Package Managers (winget) zur Installation dieses Tools können Sie den Ollama-Installer auch von der offiziellen Webseite oder von dieser GitHub -Seite beziehen.

Mit dem Befehl können Sie auch ollama --helpandere verfügbare Befehle anzeigen lassen, und mit dem ollama run --helpBefehl können Sie die für ein bestimmtes Modell verfügbaren Befehle auflisten.