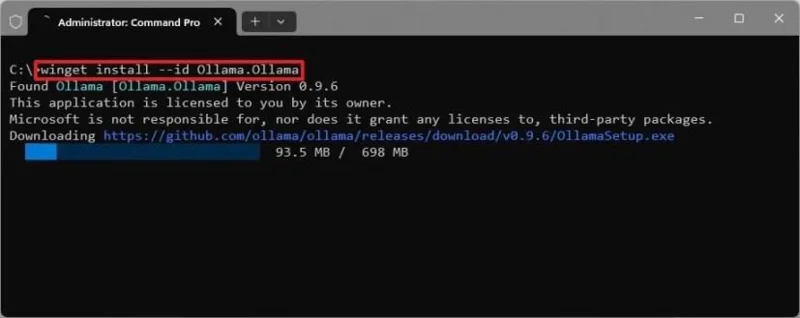

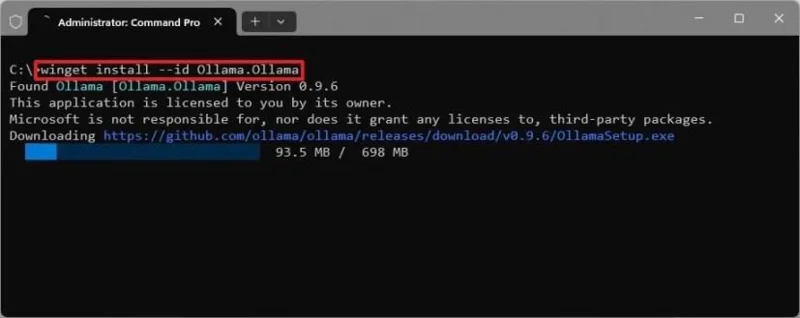

- Um das GPT-OSS KI-Modell unter Windows 11 zu installieren, öffnen Sie zuerst die Eingabeaufforderung (als Administrator) und führen Sie den

winget install --id Ollama.OllamaBefehl aus.

- Zweitens müssen Sie die

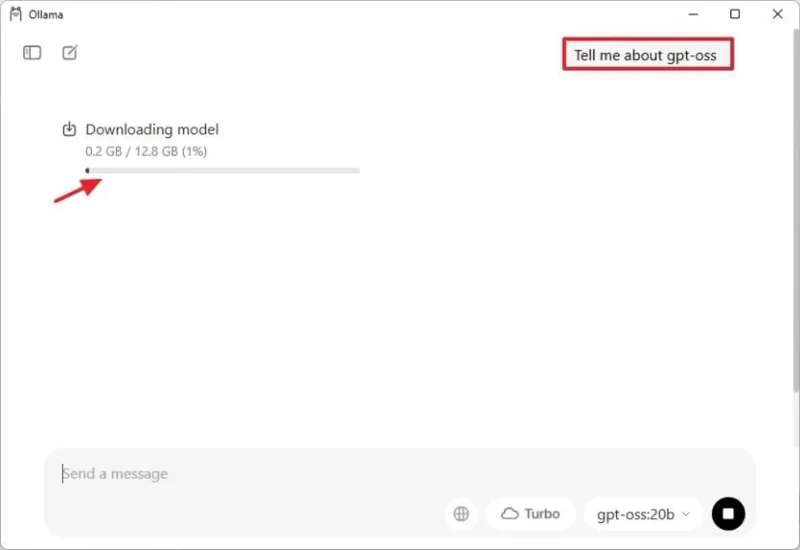

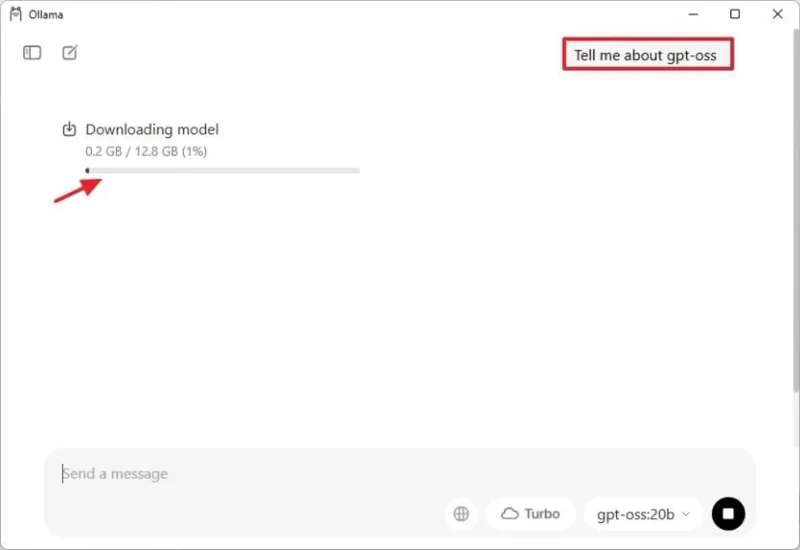

gpt-oss:20bgewünschte Option aus der Liste auswählen und eine Frage einreichen, um den Download auszulösen.

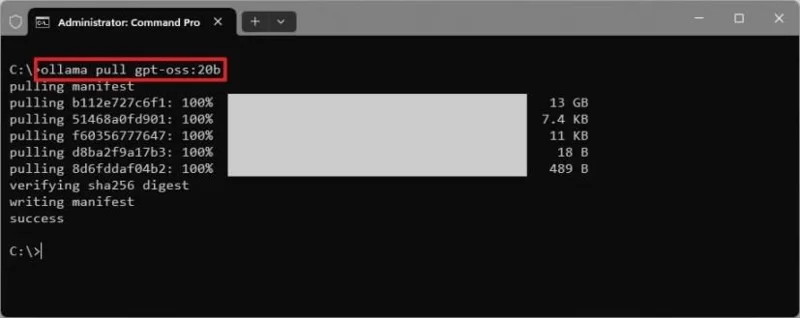

- Alternativ können Sie das Ollama-Befehlszeilentool mit der Eingabeaufforderung (Administrator) verwenden und den

ollama pull gpt-oss:20b Befehl nutzen, um beispielsweise GPT-OSS lokal auf Ihrem Computer herunterzuladen und zu installieren.

Unter Windows 11 können Sie das neueste GPT-OSS (Open Source Software) KI-Modell von OpenAI lokal auf Ihrem Computer installieren und ausführen. In diesem Leitfaden beschreibe ich die Schritte zur Durchführung dieser Konfiguration.

GPT-OSS ist ein textbasiertes Modell aus der Familie der OpenAI-Sprachmodelle mit offener Gewichtung für große Sprachgruppen. Aktuell existieren zwei Versionen: gpt-oss-20b (mit ca. 21 Milliarden Parametern) und gpt-oss-120b (mit ca. 117 Milliarden Parametern). Beide wurden unter der Apache-2.0-Lizenz veröffentlicht, sodass sie frei heruntergeladen, ausgeführt, modifiziert und weiterverbreitet werden können.

- gpt-oss-20b: Kompakt genug, um auf normaler Hardware mit mindestens 16 GB Arbeitsspeicher (z. B. Laptops, leistungsstarke Smartphones) zu laufen und eignet sich hervorragend für lokale Aufgaben mit geringer Latenz.

- gpt-oss-120b: Es handelt sich um das größere Modell, das für leistungsstarke Berechnungsaufgaben entwickelt wurde und auf High-End-Systemen wie einer einzelnen 80-GB-GPU läuft und eine Leistung nahe der O4-mini bietet.

Diese Modelle unterstützen Gedankenketten, den Einsatz von Werkzeugen, lange Kontextfenster und bieten konfigurierbare Schlussfolgerungsebenen wie niedrig, mittel und hoch für mehr Flexibilität.

Was kann ich als normaler Benutzer mit GPT-OSS machen?

Wenn Sie ein technikaffiner Nutzer, Entwickler oder Enthusiast sind, ermöglichen Ihnen die neuen OpenAI-Modelle, den Chatbot lokal auf Ihrem Computer ohne Abonnement auszuführen und die volle Kontrolle über Ihre Daten zu behalten.

Wenn Sie sich die Aufgabe zutrauen, können Sie mit dem Modell experimentieren, es anpassen und feinabstimmen, da es unter der Apache 2.0-Lizenz steht.

Normalerweise nutzt man GPT-OSS für Programmierhilfe, die Lösung komplexer Probleme, Konversationen und agentenbasierte Arbeitsabläufe . Darüber hinaus kann man es auch offline, also ohne Internetverbindung, verwenden.

Wer ist die Zielgruppe für OpenAI GPT-OSS?

Diese KI-Modelle sind speziell auf Entwickler, Forscher, Akademiker und technisch versierte Personen zugeschnitten.

Wenn Sie diese KI-Modelle lokal (unabhängig von der Cloud) auf Ihrem Computer ausführen möchten, ist die einfachste Methode die Verwendung von Ollama. Ollama ist ein Open-Source-Tool , mit dem Sie große Sprachmodelle direkt auf Ihrem lokalen Computer unter Windows 11, 10 oder einer anderen Plattform ausführen können.

Obwohl die Installation und Ausführung von KI-Modellen auf Geräten mit einer NPU (Neural Processing Unit) , wie beispielsweise einem Copilot+ PC mit Snapdragon-Prozessor, optimal ist , lassen sich diese Modelle praktisch auf jeder Hardware ausführen. Ollama arbeitet zudem mit Nvidia zusammen, um GPT-OSS auf GeForce RTX- und RTX Pro-GPUs zu beschleunigen .

Einziger Vorbehalt: Ohne eine NPU oder eine leistungsfähige GPU kann der KI-Chatbot sehr lange brauchen, um eine einfache Frage zu beantworten.

In diesem Leitfaden beschreibe ich die Schritte zur Einrichtung der Gemma AI-Modelle unter Windows 11.

GPT-OSS unter Windows 11 mit Ollama installieren (GUI-Methode)

Um GPT-OSS oder 3n lokal unter Windows 11 zu installieren, befolgen Sie diese Schritte:

-

Öffnen Sie das Startmenü unter Windows 11.

-

Suchen Sie nach „Eingabeaufforderung“ (oder „Terminal“ ), klicken Sie mit der rechten Maustaste auf das oberste Ergebnis und wählen Sie die Option „Als Administrator ausführen“ .

-

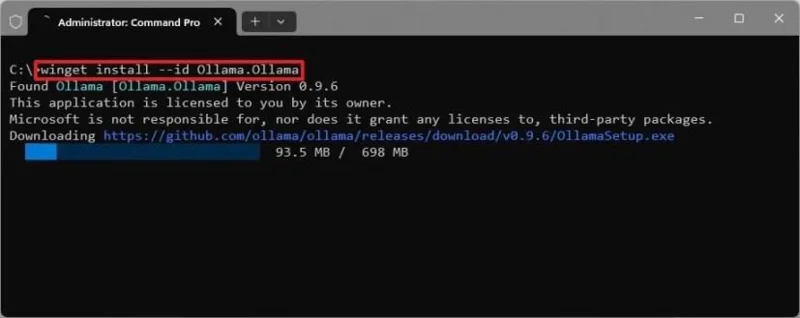

Geben Sie diesen Befehl ein, um das offizielle Ollama-Tool zu installieren, und drücken Sie die Eingabetaste :

Winget-Installation --id Ollama.Ollama

-

Klicken Sie auf die Schaltfläche „Fertigstellen “, um die Installation abzuschließen.

-

Öffnen Sie die Ollama- App über das Startmenü, falls sie nicht automatisch gestartet wurde.

-

Klicken Sie auf das Menü des KI-Modells und wählen Sie die Option „GPT-OSS:20b“ .

-

Formulieren und senden Sie eine Frage ab, um den Download des OpenAI GPT-Modells zu starten.

Sobald Sie die Schritte abgeschlossen haben, können Sie das GPT-OSS KI-Modell über die Befehlszeilenschnittstelle verwenden.

Wenn Sie über ein Ollama-Konto verfügen , können Sie sich anmelden und die integrierte Websuche nutzen, um die Möglichkeiten des Modells mit den neuesten online verfügbaren Informationen zu kombinieren.

Falls Sie sich fragen, was Turbo ist: Es handelt sich um einen Cloud-basierten Dienst von Ollama, mit dem Sie große KI-Modelle auf Hardware in Rechenzentrumsqualität ausführen können. Er bietet hohe Leistung und Geschwindigkeit für Modelle, die für die Ausführung auf einem lokalen Computer zu groß oder zu langsam wären. Das Monatsabonnement kostet 20 US-Dollar.

Die Ollama-App bietet keine Möglichkeit, die verfügbaren KI-Modelle vorab herunterzuladen. Dies lässt sich jedoch über das Kommandozeilen-Tool erledigen.

GPT-OSS unter Windows 11 mit Ollama installieren (CLI-Methode)

Um OpenAI GPT-OSS lokal unter Windows 11 zu installieren, befolgen Sie diese Schritte:

-

Öffnen Start .

-

Suchen Sie nach „Eingabeaufforderung“ (oder „Terminal“ ), klicken Sie mit der rechten Maustaste auf das oberste Ergebnis und wählen Sie die Option „Als Administrator ausführen“ .

-

Geben Sie diesen Befehl ein, um das offizielle Ollama-Tool zu installieren, und drücken Sie die Eingabetaste :

Winget-Installation --id Ollama.Ollama

-

Klicken Sie auf die Schaltfläche „Fertigstellen “, um die Installation abzuschließen.

-

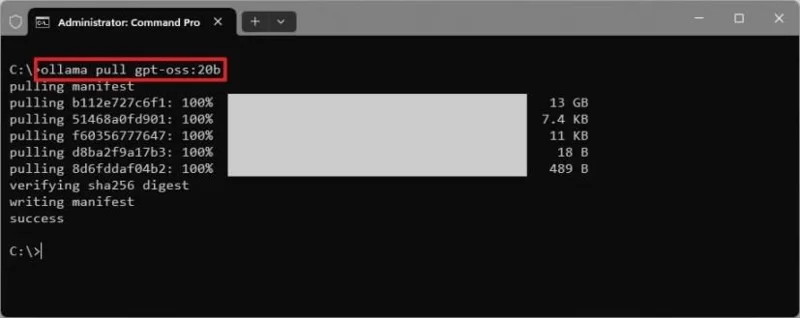

(Option 1) Geben Sie diesen Befehl ein, um das kleinere GPT-OSS KI-Modell lokal zu installieren, und drücken Sie die Eingabetaste :

ollama pull gpt-oss:20b

Kurzer Hinweis: Dieser Befehl lädt gpt-oss:20b herunter, das 20 Milliarden Parameter enthält. Alternativ können Sie auch die gpt-oss:latestOption verwenden, um das aktuellste verfügbare Modell herunterzuladen.

-

(Option 2) Geben Sie diesen Befehl ein, um das größere GPT-OSS KI-Modell lokal zu installieren, und drücken Sie die Eingabetaste :

ollama pull gpt-oss:120b

-

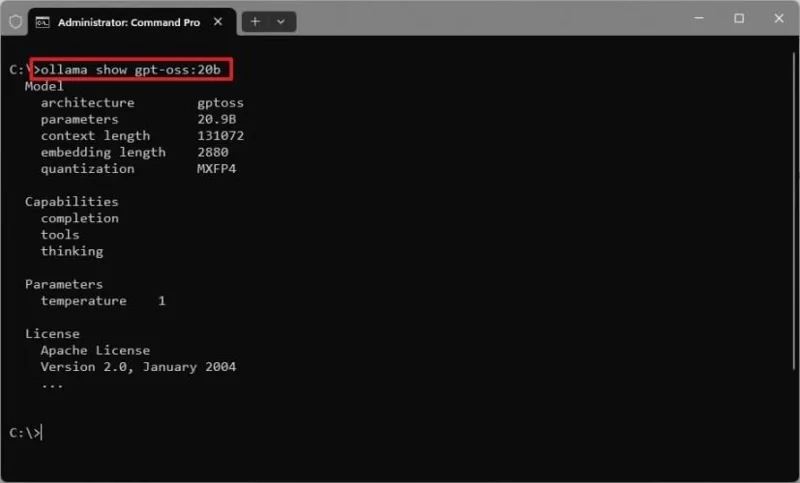

(Optional) Geben Sie diesen Befehl ein, um zu bestätigen, dass das KI-Modell installiert wurde, und drücken Sie die Eingabetaste :

Ollama-Liste

-

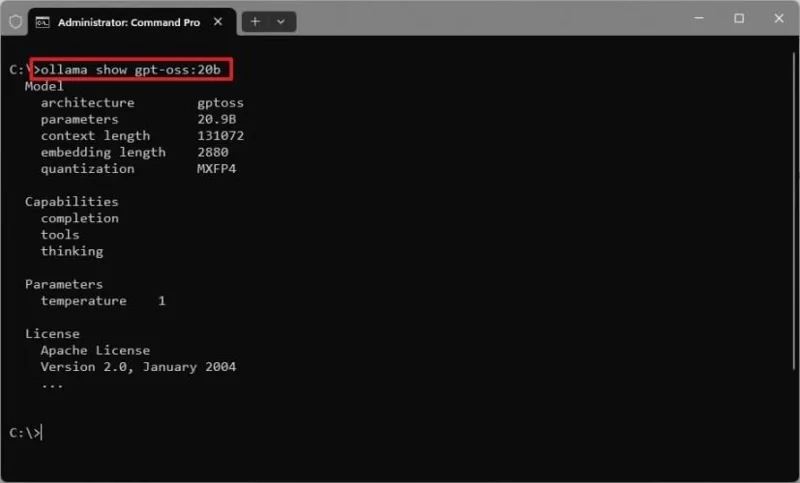

(Optional) Geben Sie diesen Befehl ein, um Details (zum Beispiel) des kleineren GPT-OSS-Modells, wie Konfiguration und Parameter, anzuzeigen, und drücken Sie die Eingabetaste :

ollama show gpt-oss:20b

-

Geben Sie diesen Befehl ein, um beispielsweise das GTP-OSS-Modell auszuführen, und drücken Sie die Eingabetaste :

ollama run gpt-oss:20b

Sobald Sie die Schritte abgeschlossen haben, können Sie das neueste Open-Source-GPT-KI-Modell von OpenAI über die Befehlszeilenschnittstelle verwenden.

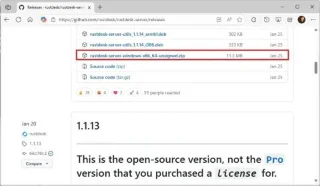

Neben der Verwendung des Windows Package Managers (winget) zur Installation dieses Tools können Sie den Ollama-Installer auch von der offiziellen Webseite oder von dieser GitHub -Seite beziehen.

Mit dem Befehl können Sie auch ollama --helpandere verfügbare Befehle anzeigen lassen, und mit dem ollama run --helpBefehl können Sie die für ein bestimmtes Modell verfügbaren Befehle auflisten.

Wenn Sie planen, eines dieser KI-Modelle auf Ihrem Computer auszuführen, sollten Sie sich aufgrund seines geringen Speicherbedarfs und seiner Hardwareanforderungen für das Modell gpt-oss-20b entscheiden.

Wenn Sie das gpt-oss-120b -Modell verwenden möchten , benötigen Sie sehr leistungsfähige Hardware, wie z. B. eine NVIDIA-GPU mit mindestens 80 GB VRAM, einen Serverprozessor (z. B. AMD EPYC oder Intel Xeon), mindestens 256 GB Arbeitsspeicher und eine schnelle NVMe-SSD mit mindestens 500 GB freiem Speicherplatz für Modellgewichte und temporäre Dateien.