- Google und andere Suchmaschinen indexieren ChatGPT-Konversationen und stellen sie in den Suchergebnissen zur Verfügung, wodurch sensible Informationen online offengelegt werden können.

- Das Problem wurde durch eine experimentelle Option in ChatGPT verursacht, die es Suchmaschinen ermöglichte, die Links zu entdecken; diese Funktion wurde jedoch inzwischen entfernt.

- Sie können Ihre gemeinsamen Unterhaltungen jederzeit über die „Datenkontroll“-Einstellungen in ChatGPT steuern und diejenigen Chats löschen, auf die andere keinen Zugriff mehr haben sollen.

Google scheint ChatGPT-Chats aus geteilten Unterhaltungen mit einem öffentlichen Link zu indexieren, aber das ist nicht so schlimm. Ich erkläre Ihnen, was passiert und was Sie tun müssen: Prüfen Sie, ob Sie öffentliche Links haben, die möglicherweise in der Google-Suche und anderen Suchmaschinen erscheinen könnten, und wie Sie diese löschen.

In letzter Zeit kursieren viele Berichte, die besagen, dass Google tatsächlich jene Chats (mit möglicherweise sensiblen Daten) durchsucht, die Sie über die „Teilen“ -Option von ChatGPT geteilt haben.

Ein Grund dafür ist eine experimentelle Funktion, die OpenAI in ChatGPT integriert hat. Diese ermöglicht es Nutzern, bestimmte Konversationen für Suchmaschinen wie Google, Bing und andere auffindbar zu machen. Für diese Funktion mussten Nutzer beim Erstellen eines öffentlichen Links die Option „Diesen Chat auffindbar machen“ aktivieren .

Die (etwas) gute Nachricht ist, dass Google Search bisher anscheinend einige tausend Links indexiert hat (wie Olaf Kopp von der Aufgesang GmbH anmerkte). Das ist zwar nicht viel, aber besorgniserregend. OpenAI hat seit dem Vorfall außerdem mitgeteilt , die betreffende Funktion aus ChatGPT entfernt zu haben und arbeitet aktiv daran, indexierte Inhalte aus relevanten Suchmaschinen zu entfernen.

Wenn Sie ChatGPT im Web oder mit der ChatGPT-App für Windows 11 nutzen oder ChatGPT als Ihren Standardbrowser in Chrome oder Microsoft Edge festgelegt haben und Bedenken haben, können Sie jederzeit überprüfen, ob Ihre Unterhaltungen in der Google-Suche (oder einer anderen Suchmaschine) erscheinen, und Sie können auch Ihr Konto überprüfen, um mögliche Datenlecks zu beseitigen.

In diesem Leitfaden beschreibe ich die Schritte, um zuvor geteilte Konversationen in ChatGPT zu überprüfen und zu löschen, damit sie nicht in Suchmaschinen oder anderen Personen angezeigt werden.

Zuvor geteilte Konversationslinks aus ChatGPT löschen

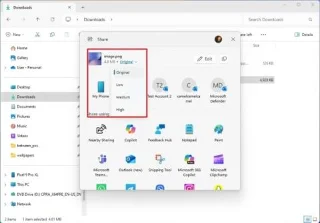

Um zu verhindern, dass öffentlich geteilte Links aus Konversationen mit dem ChatGPT-Chatbot von Google indexiert werden, befolgen Sie diese Schritte:

-

Eröffnen Sie Ihr ChatGPT- Konto.

-

Klicken Sie auf Ihr Profil und wählen Sie die Option „Einstellungen“ .

-

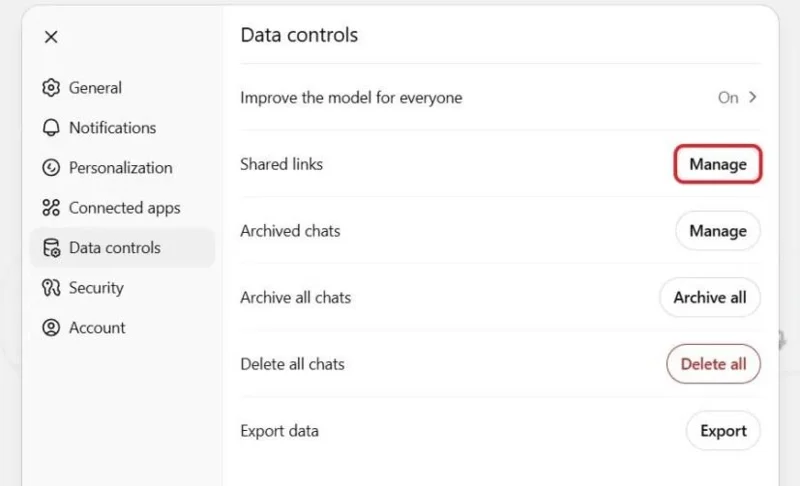

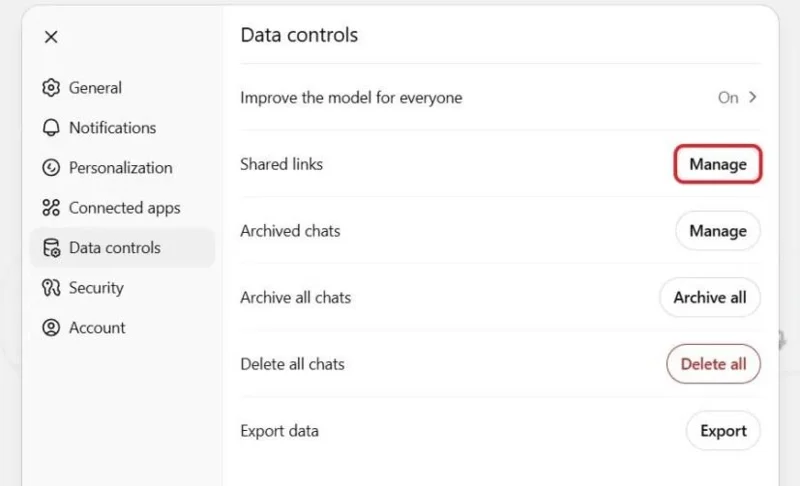

Klicken Sie auf Datensteuerung .

-

Klicken Sie auf die Schaltfläche „Verwalten“ für die Einstellung „Freigegebene Links“.

-

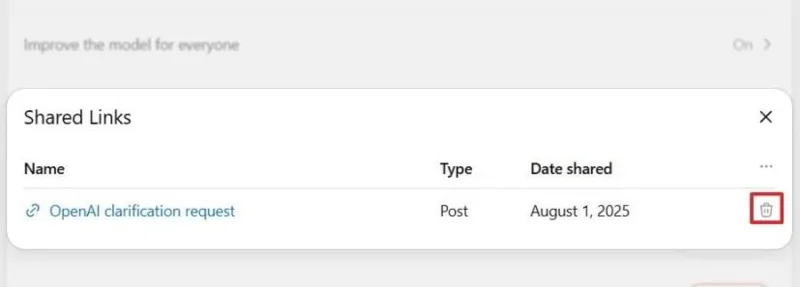

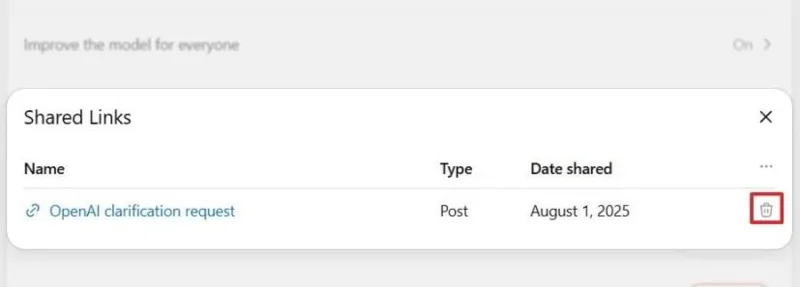

Bestätigen Sie die teilbaren Links, die Sie möglicherweise mit ChatGPT erstellt haben.

-

(Optional) Öffnen Sie die Google-Suche in Ihrem Browser.

-

Führen Sie eine Suche durch, site:chatgpt.com/share + keywordum zu überprüfen, ob Ihre Konversationen von der Suchmaschine indexiert wurden.

-

Klicken Sie für jede ChatGPT-Konversation, die nicht in der öffentlichen Suche angezeigt werden soll, auf die Schaltfläche „Löschen“ .

Kleiner Tipp: Sie können auch auf die Schaltfläche mit den drei Punkten klicken und die Option „Alle geteilten Links löschen“ auswählen.

Sobald Sie die Schritte abgeschlossen haben, wird die Konversation mit dem Chatbot, die möglicherweise sensible Informationen enthält, nicht von Google indexiert.

Vermeiden Sie nach Möglichkeit die Option, eine Unterhaltung per Link zu teilen. Markieren und kopieren Sie stattdessen den Inhalt und fügen Sie ihn in ein Dokument oder eine E-Mail ein, um ihn mit anderen zu teilen.

Wenn die Konversation bereits indexiert wurde, sollte nach ihrer Löschung niemand mehr auf den Inhalt zugreifen können, der auf den Link auf der Ergebnisseite klickt.

Darüber hinaus rät Christopher Penn , Mitbegründer und Chief Data Scientist bei TrustInsights.ai , von der Interaktion mit Online-Chats ab, da die Gefahr einer sofortigen Infektion besteht .

Bei der Prompt-Injection handelt es sich um eine Sicherheitslücke, bei der bösartige Texteingaben ein großes Sprachmodell (LLM) dazu verleiten, seine beabsichtigten Anweisungen zu ignorieren oder unbeabsichtigte Aktionen auszuführen, oft indem die vom Entwickler festgelegten Richtlinien mit vom Benutzer bereitgestellten Befehlen überschrieben werden.