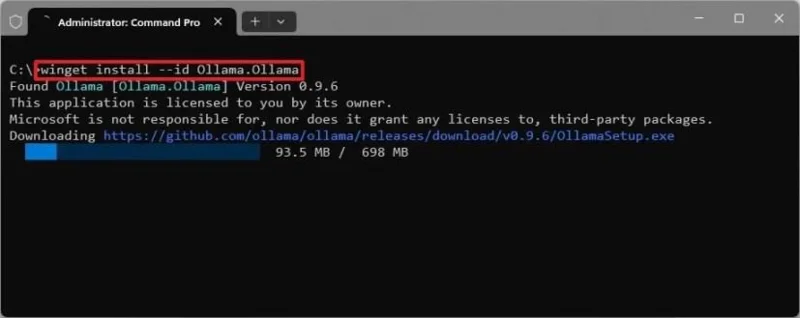

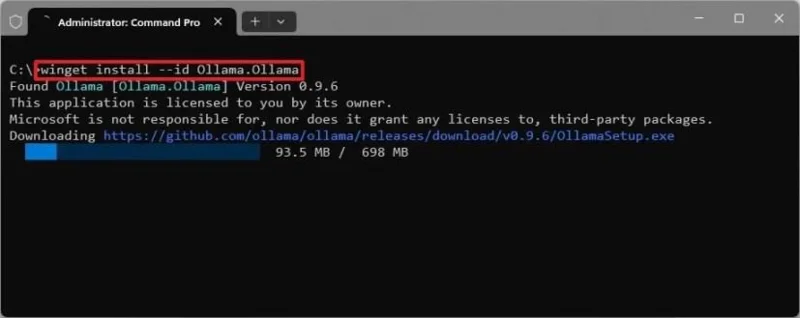

- Para instalar Ollama en Windows 11, abra el Símbolo del sistema como administrador y ejecute el

winget install --id Ollama.Ollamacomando.

- Una vez instalado, utilice el

ollama pull comando para descargar y ejecutar localmente herramientas LLM como Gemma, LLaMA y DeepSeek.

- Como alternativa, puedes iniciar la aplicación Ollama para instalar y ejecutar los modelos que desees.

- Ollama funciona independientemente de la nube y permite ejecutar modelos a través de una interfaz de línea de comandos o una interfaz personalizada.

ACTUALIZADO EL 21/08/2025: En Windows 11 , puedes instalar Ollama para descargar y ejecutar varios modelos de IA localmente en tu ordenador, y en esta guía, describiré los pasos para completar esta configuración.

Aunque Windows 11 incluye numerosos modelos de IA integrados para hardware específico, como los PC con Copilot+, estos suelen ser modelos pequeños y especializados. Por lo tanto, la principal forma de interactuar con los grandes modelos de lenguaje (LLM) de IA es mediante chatbots en línea, como Microsoft Copilot, OpenAI ChatGPT y Google Gemini , entre otros.

La desventaja de usar estos sistemas LLM es que procesan todas las solicitudes en la nube, algo que no todos desean. Aquí es donde Ollama se convierte en una herramienta valiosa.

Ollama es una herramienta de código abierto que permite ejecutar modelos de lenguaje complejos directamente en su ordenador con Windows 11, 10 u otros sistemas operativos compatibles, mediante la línea de comandos o una interfaz gráfica. Está diseñada para simplificar el proceso de descarga, ejecución y gestión de estos modelos de IA para usuarios individuales, desarrolladores e investigadores.

En esta guía , describiré los pasos para configurar una de las herramientas más sencillas para ejecutar LLM localmente en su ordenador.

Instala Ollama en Windows 11 para ejecutar modelos de IA localmente.

Para instalar Ollama localmente en Windows 11, siga estos pasos:

-

Abre el menú Inicio en Windows 11.

-

Busque " Símbolo del sistema" (o "Terminal "), haga clic con el botón derecho en el primer resultado y seleccione la opción " Ejecutar como administrador" .

-

(Opción 1) Escriba este comando para instalar la herramienta oficial de Ollama y pulse Intro :

instalación de ala --id Ollama.Ollama

-

Haz clic en el botón Finalizar .

-

(Opción 2) Escriba este comando para desinstalar Ollama de Windows 11 y pulse Intro :

Desinstalación de Winget--id Ollama.Ollama

Consejo rápido: Se recomienda desinstalar cualquier modelo de IA del ordenador antes de eliminar Ollama.

Una vez completados los pasos, Ollama se ejecutará en segundo plano y, a continuación, podrá ollama interactuar con él mediante la línea de comandos desde el Símbolo del sistema o PowerShell.

Además de usar el Administrador de paquetes de Windows (Winget) para instalar esta herramienta, siempre puedes obtener el instalador de Ollama desde su página oficial o desde esta página de GitHub .

Instala y ejecuta módulos de aprendizaje automático con IA usando Ollama en Windows 11.

Antes de comenzar con la instalación, abre la página de la biblioteca de Ollama para decidir qué modelo de IA deseas instalar.

En la página encontrará una lista de los modelos disponibles de DeepSeek , Google (gemma), Meta (llama) y otros.

También observará que cada modelo tiene notaciones como 1b, 4b, 12b, etc., que indican la cantidad de parámetros en miles de millones. Una mayor cantidad de parámetros indica un modelo más grande y potencialmente más potente. Sin embargo, también requerirán un hardware más potente.

Si estás empezando, deberías descargar la versión más pequeña disponible (por ejemplo, "1b").

Para instalar un modelo de IA usando Ollama en Windows 11, siga estos pasos:

-

Abrir Inicio .

-

Busque " Símbolo del sistema" (o "Terminal "), haga clic con el botón derecho en el primer resultado y seleccione la opción " Ejecutar como administrador" .

-

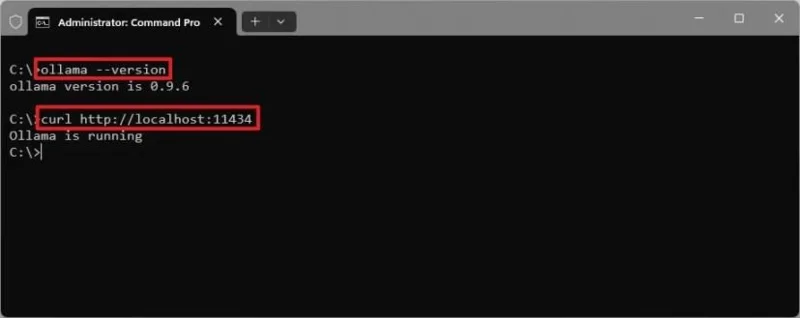

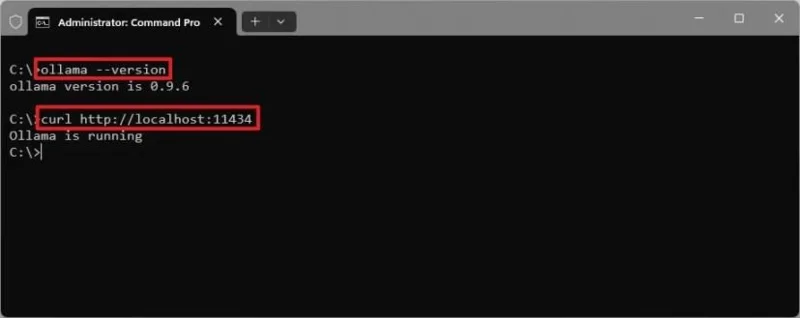

(Opcional) Escriba este comando para comprobar la versión de Ollama y pulse Intro :

ollama --versión

-

(Opcional) Escriba este comando para confirmar que Ollama se está ejecutando y pulse Intro :

curl http://localhost:11434

-

(Opción 1) Escriba este comando para instalar y ejecutar el modelo de IA localmente en su computadora y presione Enter :

ollama pull gemma3:1b

Nota rápida: Este comando descarga la versión 3 de Google Gemma, que incluye mil millones de parámetros. En su comando, actualice gemma3:1b el nombre del modelo y la versión que desea instalar, por ejemplo deepseek-r1:1.5b: .

-

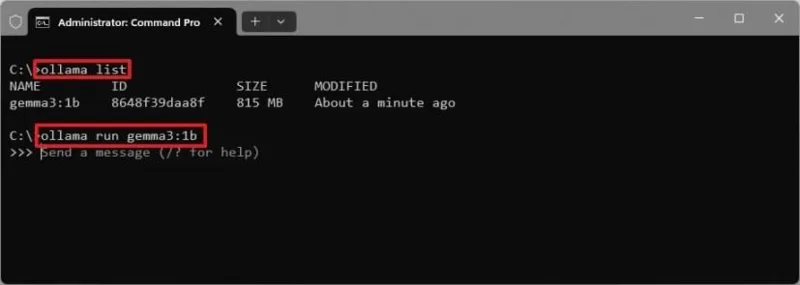

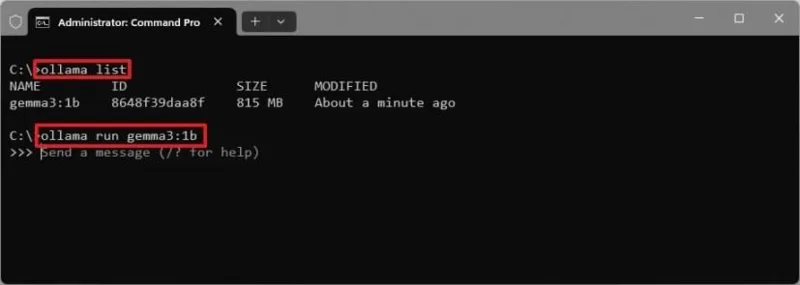

(Opcional) Escriba este comando para ver los modelos instalados y pulse Intro :

lista de ollama

-

(Opción 2) Escriba este comando para desinstalar un modelo de IA de su computadora y presione Enter :

ollama rm gemma3:1b

-

Escriba este comando para confirmar que el modelo ya no está en su ordenador y pulse Intro :

lista de ollama

-

Escriba este comando para ejecutar un modelo de IA instalado con Ollama y pulse Intro :

ollama run gemma3:1b

En el comando, confirme el modelo que desea comenzar a usar con Ollama.

-

(Opcional) Escriba este comando para mostrar todos los procesos en ejecución de Ollama y pulse Intro :

ollama ps

-

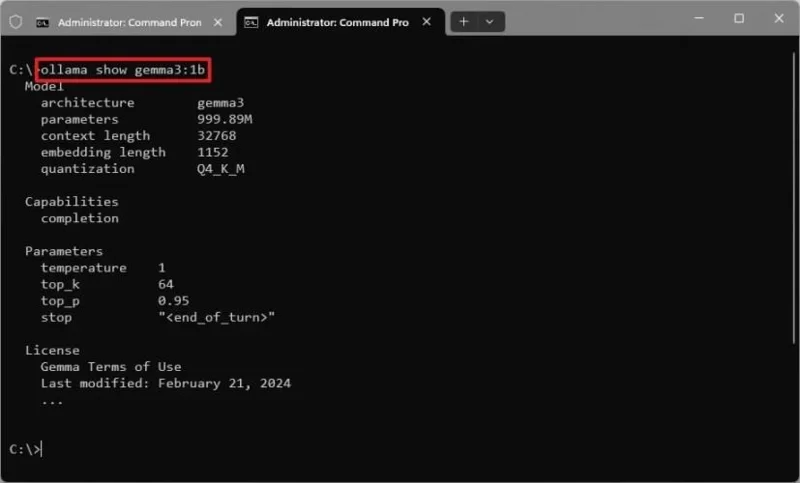

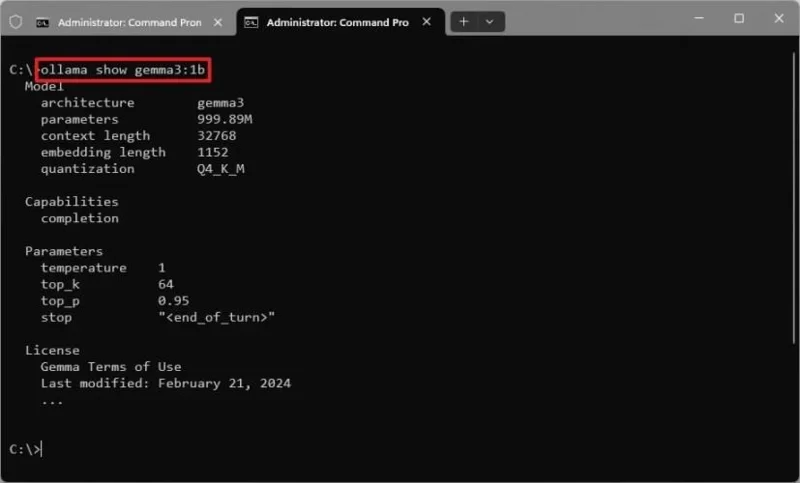

(Opcional) Escriba este comando para mostrar los detalles de un modelo específico, como la configuración y los parámetros, y pulse Intro :

ollama muestra gemma3:1b

En el comando, confirme el modelo que desea comenzar a usar con Ollama.

Una vez completados los pasos, podrá empezar a utilizar LLM a través de la interfaz de línea de comandos.

También puede utilizar el ollama --helpcomando para ver otros comandos disponibles, y el ollama run --helpcomando para listar los comandos disponibles para un modelo específico.

Instalar y ejecutar modelos lógicos de aprendizaje automático (LLM) con IA usando Ollama en Windows 11 (método GUI).

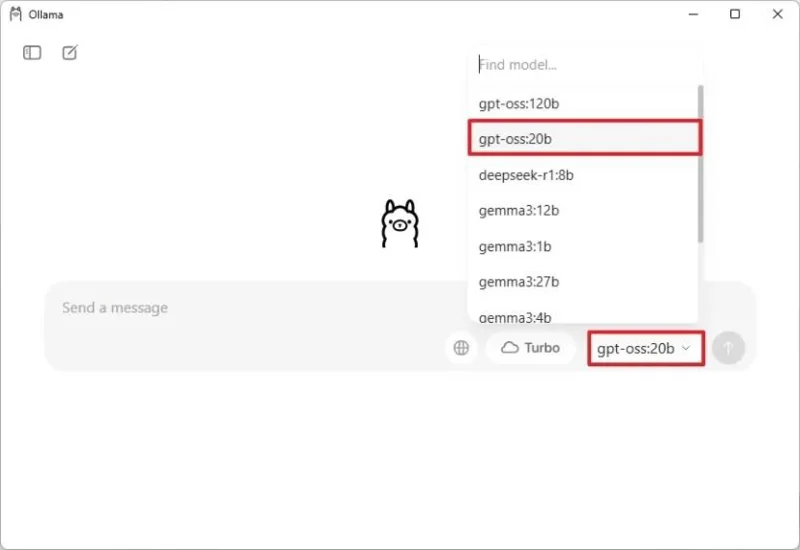

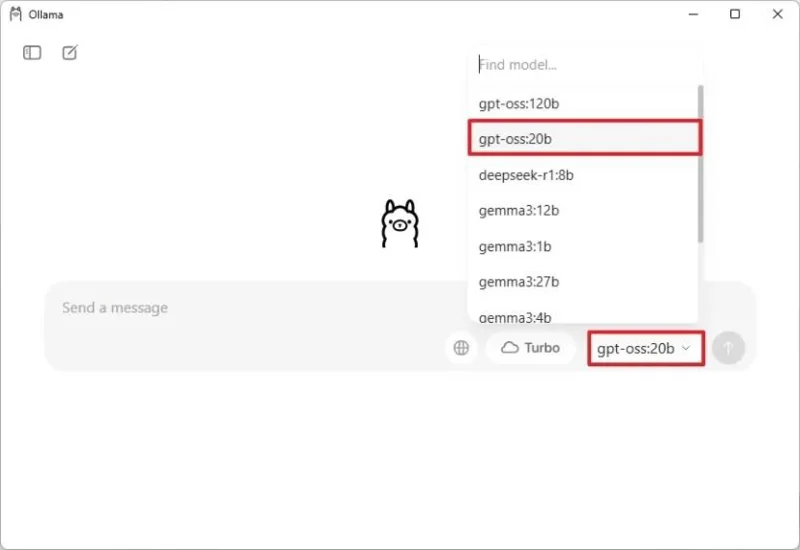

Para instalar un modelo de IA utilizando la aplicación Ollama GUI en Windows 11, siga estos pasos:

-

Si la aplicación Ollama no se inició automáticamente después de la instalación, ábrela desde el menú Inicio.

-

Haz clic en el menú del modelo de IA y selecciona el modelo que deseas descargar. Por ejemplo, la opción “GPT-OSS:20b” .

-

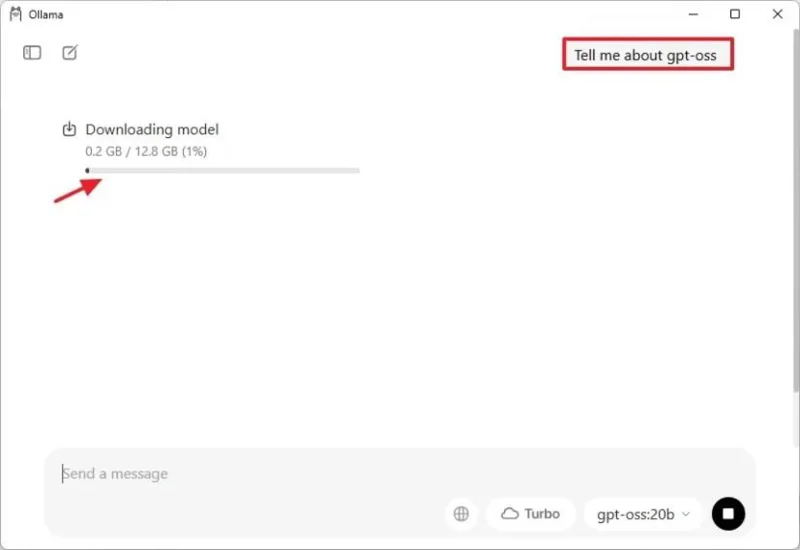

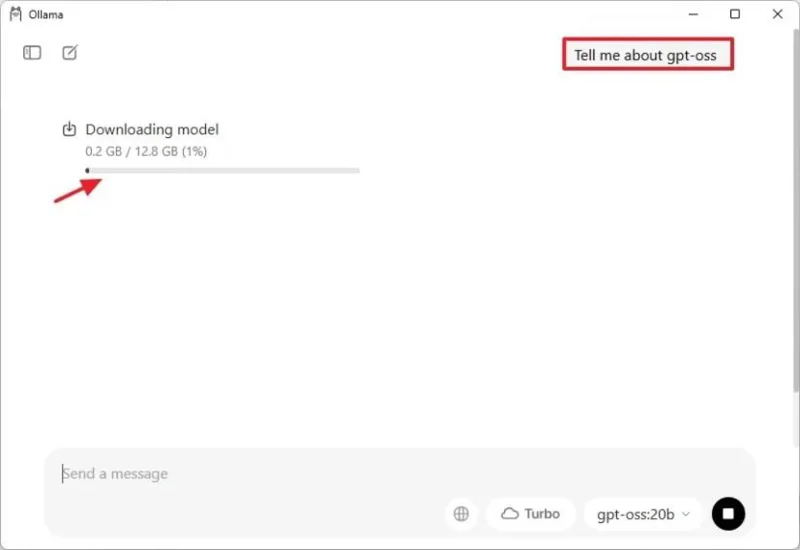

Redacta y envía una pregunta para iniciar la descarga del modelo GPT de OpenAI.

Una vez completados los pasos, el modelo de IA se descargará en su ordenador a través de la interfaz gráfica de usuario.

Si tienes una cuenta de Ollama , puedes iniciar sesión para usar el buscador web integrado y combinar las capacidades del modelo con la información más reciente disponible en línea.

La opción Turbo es un servicio en la nube de Ollama para ejecutar modelos de IA de gran tamaño utilizando hardware de centro de datos. Está diseñado para ofrecer alto rendimiento y velocidad a modelos que podrían ser demasiado grandes o lentos para ejecutarse en un ordenador local. La suscripción mensual tiene un precio de 20 dólares.

La aplicación Ollama no ofrece la opción de predescargar los modelos de IA disponibles. Sin embargo, puede realizar esta tarea desde la línea de comandos, como se describe anteriormente.

Preguntas frecuentes sobre Ollama en Windows 11

Si aún tienes dudas sobre Ollama, las siguientes preguntas frecuentes te ayudarán a aclarar diferentes aspectos de esta herramienta. Puedes publicar tus preguntas en los comentarios a continuación.

¿Necesitas algún hardware de IA específico para ejecutar Ollama?

No, puedes ejecutar los modelos básicos de IA que adquiriste con Ollama usando hardware relativamente moderno, y no necesitas una Unidad de Procesamiento Neuronal (NPU). Ollama también puede ejecutarse directamente en el procesador, pero se recomienda encarecidamente una tarjeta gráfica.

Sin embargo, necesitarás hardware específico para ejecutar los diferentes modelos de IA según sus parámetros. Por ejemplo, puedes ejecutar el modelo gpt-oss-20b con hardware moderno estándar, pero si quieres usar el modelo gpt-oss-120b , necesitarás hardware muy potente, como una GPU NVIDIA con al menos 80 GB de VRAM, un procesador de servidor (por ejemplo, AMD EPYC o Intel Xeon), al menos 256 GB de memoria y una unidad SSD NVMe de alta velocidad con al menos 500 GB libres para los pesos del modelo y los archivos temporales.

¿Cuáles son los requisitos del sistema de Ollama para Windows 11?

Los requisitos del sistema para instalar Ollama en Windows 11 o 10 son moderados:

- Procesador: Intel o AMD x86-64.

- Memoria: 8 GB, pero se recomienda 16 GB o más.

- Almacenamiento: 10 GB de espacio libre.

- Gráficos: GPU integrada o dedicada.

Aunque los requisitos no son exigentes, recomiendo un procesador multinúcleo moderno, al menos 32 GB de RAM, más de 256 GB de espacio libre en una unidad SSD (preferiblemente NVMe) y una tarjeta gráfica como la serie RTX 30xx de Nvidia. Sin embargo, también se puede usar una GPU AMD Radeon equivalente.

Además, para los modelos avanzados, se recomienda un mínimo de 4 GB de VRAM.

Cuanto mayor sea el modelo, más recursos se requerirán, lo que significa que la máquina necesitará un hardware más robusto.

¿Ollama utiliza virtualización para ejecutarse en Windows 11?

No, Ollama no crea una máquina virtual por sí misma. Sin embargo, sí crea un entorno aislado en el sistema para ejecutar modelos lineales de aprendizaje (LLM). Este entorno incluye todos los componentes necesarios, como los pesos del modelo (los datos preentrenados) y los archivos de configuración.

Es importante destacar que Ollama ya no requiere WSL2 . Se ejecuta de forma nativa en la última versión de Windows 11 o 10.

Actualización del 21 de agosto de 2025: Esta guía se ha actualizado para garantizar su precisión y reflejar los cambios en el proceso.