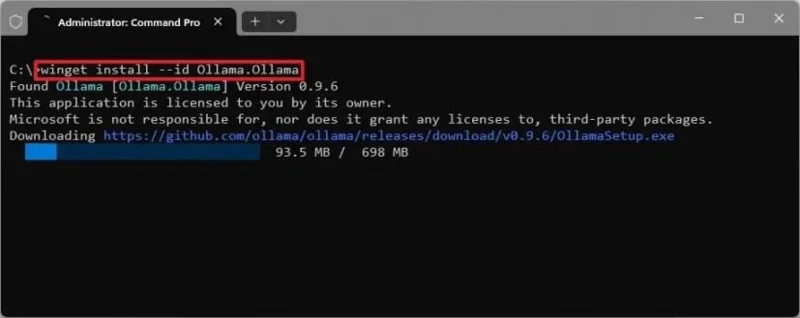

- Pour installer le modèle d'IA Google Gemma sur Windows 11, ouvrez d'abord l'invite de commandes en tant qu'administrateur et exécutez la

winget install --id Ollama.Ollamacommande.

- Deuxièmement, utilisez la

ollama pull gemma3:1bcommande pour télécharger et installer (par exemple) Gemma 3 localement sur votre ordinateur.

Sous Windows 11 , vous pouvez installer et exécuter localement sur votre ordinateur des modèles d'IA Google DeepMind, tels que Gemma 3 ou Gemma 3n, et dans ce guide, je vais détailler les étapes à suivre pour effectuer cette configuration.

Gemma 3 et 3n font partie de la famille « Gemma » de Google, une gamme de modèles d'IA ouverts et légers. Gemma 3 est conçu pour offrir des fonctionnalités étendues et une grande efficacité, tandis que Gemma 3n est spécifiquement conçu pour une efficacité optimale sur les appareils mobiles, en périphérie de réseau et autres dispositifs aux ressources limitées, intégrant même la gestion des entrées audio.

Si vous souhaitez exécuter ces modèles d'IA localement (indépendamment du cloud) sur votre ordinateur, la méthode la plus simple consiste à utiliser Ollama , un outil open-source qui vous permet d'exécuter de grands modèles de langage directement sur votre ordinateur local sous Windows 11, 10 ou une autre plateforme.

Dans ce guide , je détaillerai les étapes à suivre pour configurer les modèles d'IA Gemma sous Windows 11.

Installer le modèle d'IA Google Gemma sur Windows 11

Pour installer Gemma 3 ou 3n localement sous Windows 11, suivez ces étapes :

-

Ouvrez le menu Démarrer sous Windows 11.

-

Recherchez « Invite de commandes » (ou « Terminal » ), cliquez avec le bouton droit sur le premier résultat et choisissez l' option « Exécuter en tant qu'administrateur » .

-

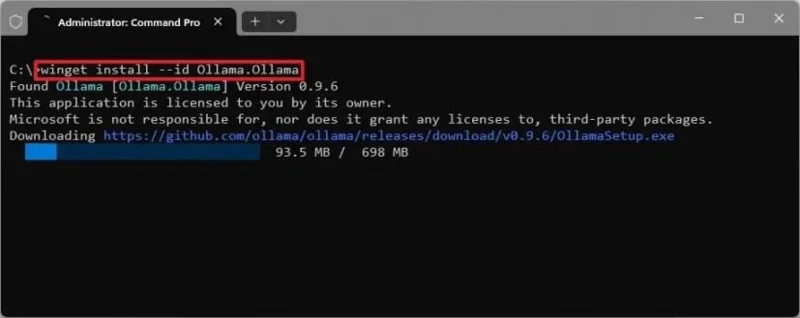

Saisissez cette commande pour installer l'outil officiel Ollama et appuyez sur Entrée :

winget install --id Ollama.Ollama

-

Cliquez sur le bouton Terminer pour achever l'installation.

-

(Option 1) Tapez cette commande pour installer localement le modèle d'IA Google Gemma 3 et appuyez sur Entrée :

ollama tire gemma3:1b

Note rapide : cette commande télécharge la version 3 de Google Gemma, qui comprend un milliard de paramètres. Dans votre commande, remplacez `<nom_du_modèle>` gemma3:1bpar le nom et la version du modèle que vous souhaitez installer, par exemple gemma3:4b` gemma3:12b<nom_du_modèle>`, `<nom_du_modèle>` ou ` <nom_du_modèle gemma3:27b>` .

-

(Option 2) Tapez cette commande pour installer localement le modèle d'IA Google Gemma 3n et appuyez sur Entrée :

ollama tire gemma3n:e2b

Note rapide : cette commande télécharge le Google Gemma 3n . Dans votre commande, remplacez gemma3n:e2ble nom du modèle et la version que vous souhaitez installer, par exemple : gemma3n:e4b.

-

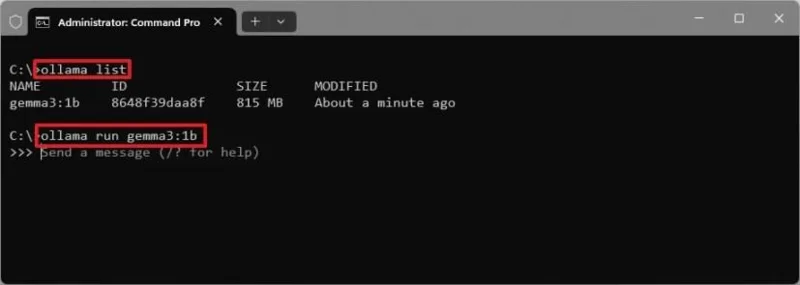

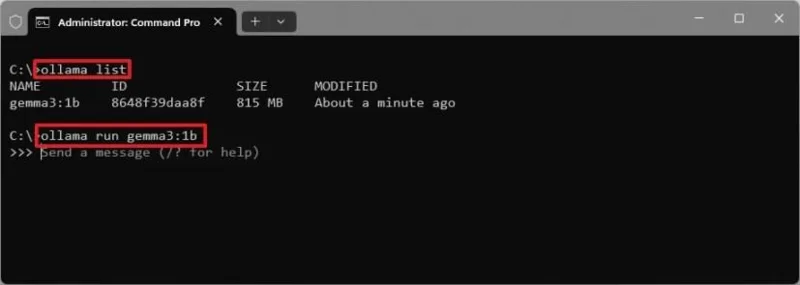

(Facultatif) Saisissez cette commande pour confirmer que le modèle d'IA a été installé et appuyez sur Entrée :

liste ollama

-

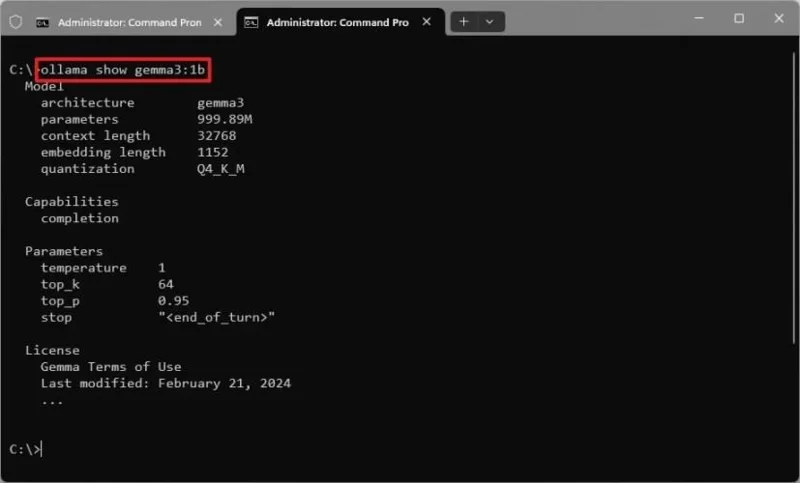

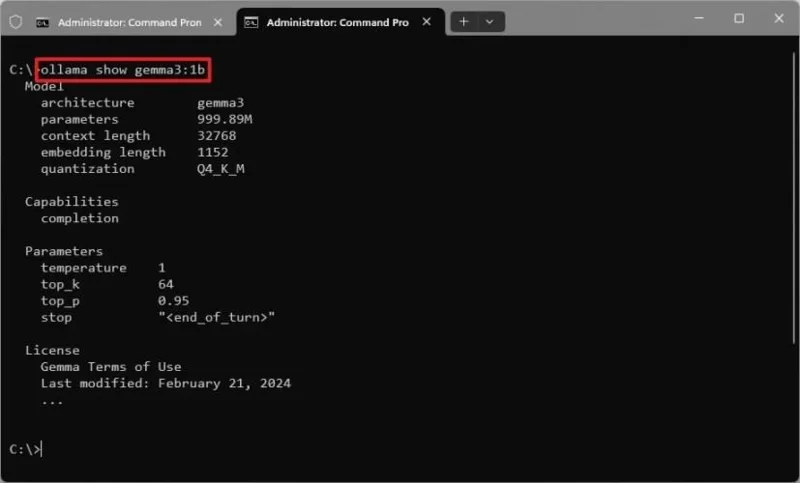

(Facultatif) Tapez cette commande pour afficher les détails (par exemple) du modèle Gemma 3, tels que la configuration et les paramètres, puis appuyez sur Entrée :

ollama show gemma3:1b

-

Saisissez cette commande pour exécuter (par exemple) le modèle d'IA Gemma 3 et appuyez sur Entrée :

ollama run gemma3:1b

Une fois ces étapes terminées, vous pourrez commencer à utiliser le modèle d'IA Google Gemma via l'interface de ligne de commande.

En plus d'utiliser le Gestionnaire de packages Windows (winget) pour installer cet outil, vous pouvez toujours obtenir le programme d'installation d'Ollama depuis sa page officielle ou cette page GitHub .

Vous pouvez également utiliser cette ollama --helpcommande pour afficher les autres commandes disponibles, et cette ollama run --helpcommande pour lister les commandes disponibles pour un modèle spécifique.